Qwen2.5 :阿里通义千问团队推出的最新大型语言模型系列

Qwen2.5 简介

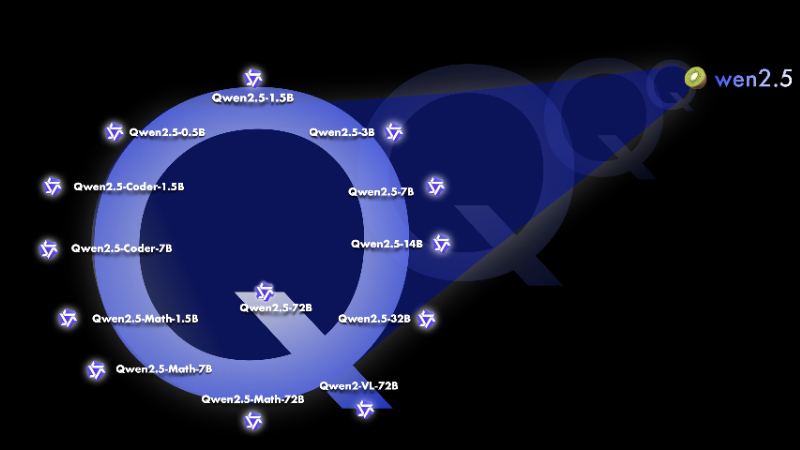

Qwen2.5是阿里通义千问团队最新发布的一系列大型语言模型,参数范围从0.5B到72B。与前一版本Qwen2相比,Qwen2.5在知识获取、编程能力和数学推理等方面有显著提升,特别是通过专门的模型如Qwen2.5-Coder和Qwen2.5-Math。该模型支持生成长文本(超过8K个token)和理解结构化数据,能够处理多达29种语言。Qwen2.5的预训练数据集达到了18万亿个token,使其在多项基准测试中表现出色,尤其是在指令跟随和生成结构化输出方面。

Qwen2.5 主要功能

- 多样化模型:Qwen2.5系列包括多个参数规模的模型,从0.5B到72B不等,满足不同应用需求。

- 增强的知识和能力:在编码和数学推理方面有显著提升,专门模型如Qwen2.5-Coder和Qwen2.5-Math提供了更强的性能。

- 指令跟随能力:显著改善了对用户指令的理解和执行能力,能够更好地生成符合人类偏好的响应。

- 长文本生成:支持生成超过8K个token的长文本,适用于复杂的文本生成任务。

- 结构化数据处理:能够理解和生成结构化输出(如JSON),适合处理表格等数据格式。

- 多语言支持:支持29种语言,包括中文、英文、法文等,增强了其全球适用性。

- 长上下文支持:能够处理长达128K tokens的上下文,提高了对长篇内容的理解和生成能力。

Qwen2.5 性能评估

- Qwen2.5

- Qwen2.5-72B在各种任务上都达到了顶尖水平,与Llama-3.1-70B、Mistral-Large-V2和DeepSeek-V2.5等领先的开源模型相比表现出色。

- 即使是基础语言模型Qwen2.5-72B,在一些任务上也超过了更大的模型如Llama-3-405B。

- API模型Qwen-Plus在与GPT4-o、Claude-3.5-Sonnet等领先模型的对比中表现出色,在某些方面与Llama-3.1-405B不相上下

- Qwen2.5-Coder

- Qwen2.5-Coder-7B-Instruct在编程语言和任务的各个方面都优于许多参数更大的模型。

- 在10多个编程相关的基准测试中,Qwen2.5-Coder系列达到了SOTA水平,在相同模型大小下一致优于其他模型。

- Qwen2.5-Math

- Qwen2.5-Math-72B-Instruct在总体性能上超过了Qwen2-Math-72B-Instruct和GPT4-o。

- 即使是Qwen2.5-Math-1.5B-Instruct这样小的专家模型,在数学推理任务上也能达到与大型语言模型相当的高水平

Qwen2.5 应用场景

- 代码生成与修复:Qwen2.5-Coder专为编程任务设计,能够自动生成代码、修复错误并提供代码建议,提升开发效率。

- 数学问题解决:Qwen2.5-Math能够处理复杂的数学问题,包括符号计算和逻辑推理,适用于教育和科研领域。

- 自然语言理解与生成:该模型可用于文本生成、摘要撰写和语言翻译,帮助用户高效处理信息。

- 聊天机器人:Qwen2.5可用于构建智能聊天机器人,支持多轮对话和角色扮演,提高用户互动体验。

- 数据分析与报告生成:模型能够分析结构化数据并生成相应的报告,适用于商业智能和数据科学领域。

- 多语言支持:支持29种语言,使其在全球范围内的应用更加广泛,适合跨国企业和多语言环境下的沟通需求。

Qwen2.5 项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号