OmniGen:可处理包括文本到图像生成、图像编辑等多种任务

OmniGen简介

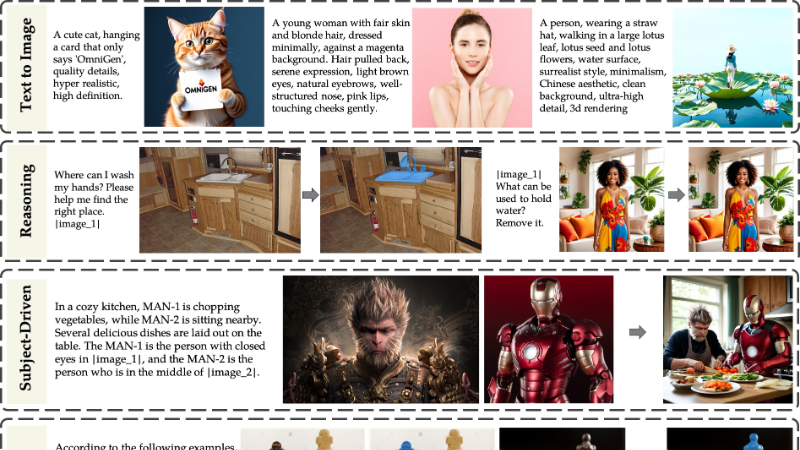

OmniGen是由北京智源人工智能研究院(BAAI)开发的新一代统一图像生成模型。该模型通过简化的架构设计,无需额外模块即可处理包括文本到图像生成、图像编辑、主题驱动生成及视觉条件生成在内的多种任务。OmniGen在单一框架内实现了多样化的控制条件处理,展示了强大的多任务处理能力和知识迁移能力,为通用图像生成领域带来了创新。此外,该模型还具备推理能力和链式思考机制,进一步扩展了其在复杂图像生成任务中的应用潜力。

OmniGen主要功能

- 文本到图像生成:OmniGen可以将文本描述直接转换成相应的图像内容。

- 图像编辑:模型能够根据文本指令对现有图像进行编辑,如添加或删除图像元素。

- 主题驱动生成:能够根据给定的参考图像和文本指令生成新图像,自动提取所需对象。

- 视觉条件生成:利用视觉条件,如边缘检测、人体姿态估计等,生成符合特定视觉特征的图像。

- 计算机视觉任务:将传统计算机视觉任务转化为图像生成任务,如图像去噪、增强等。

- 多模态输入处理:接受并处理交错的文本和图像输入,以生成新的图像。

- 知识迁移:通过统一格式学习,跨不同任务有效迁移知识,处理未见过的任务和领域。

- 推理能力:展现出一定程度的推理能力,能够理解图像内容并根据上下文进行图像编辑。

OmniGen技术原理

- 统一架构:采用变分自编码器(VAE)和预训练的大型变换器模型,简化了模型结构,无需额外编码器。

- 多模态输入:支持任意交错的文本和图像输入,通过VAE将图像转换为潜在表示,再通过线性层将图像嵌入到文本序列中。

- 注意力机制:结合了因果注意力和双向注意力机制,允许图像内部的元素相互关注,同时确保图像只能关注之前出现的文本或图像序列。

- 流匹配方法:在推理过程中,通过迭代多个步骤预测目标速度,从而获得最终的潜在表示,加速了模型的推理过程。

- 大规模统一数据集:构建了X2I数据集,将多种图像生成任务统一为一种格式,以训练模型处理多任务。

- 渐进式训练策略:在训练过程中逐步提高图像分辨率,从低分辨率开始以提高数据效率,逐步过渡到高分辨率以增强图像质量。

- 知识迁移与新兴能力:通过统一训练,模型能够将从一个任务学到的知识应用到另一个任务上,展现出新的能力。

- 链式思考机制:探索了模型的推理能力,通过逐步细化问题解决步骤来提升模型在复杂任务上的表现。

OmniGen应用场景

- 数字艺术创作:艺术家和设计师可以使用OmniGen来生成独特的艺术作品或设计原型,通过文本描述即可创造出视觉内容,加速创作过程。

- 游戏开发:游戏开发者可以利用OmniGen快速生成游戏内的场景、角色概念图或其他视觉元素,提高前期设计效率。

- 虚拟现实和增强现实:在VR和AR应用中,OmniGen可以根据用户的需求实时生成环境或对象,提供更加丰富和个性化的体验。

- 广告和营销:营销团队可以使用OmniGen根据广告文案快速生成吸引人的视觉素材,提高广告内容的创意性和吸引力。

- 教育和培训:在教育领域,OmniGen可以用来创建教学材料中的插图或模拟场景,帮助学生更好地理解和吸收复杂概念。

- 电子商务:电商平台可以利用OmniGen为用户定制个性化的产品视觉效果,如虚拟试穿服装,增强购物体验。

OmniGen项目入口

- GitHub代码库:https://github.com/VectorSpaceLab/OmniGen

- arXiv研究论文:https://arxiv.org/pdf/2409.11340

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号