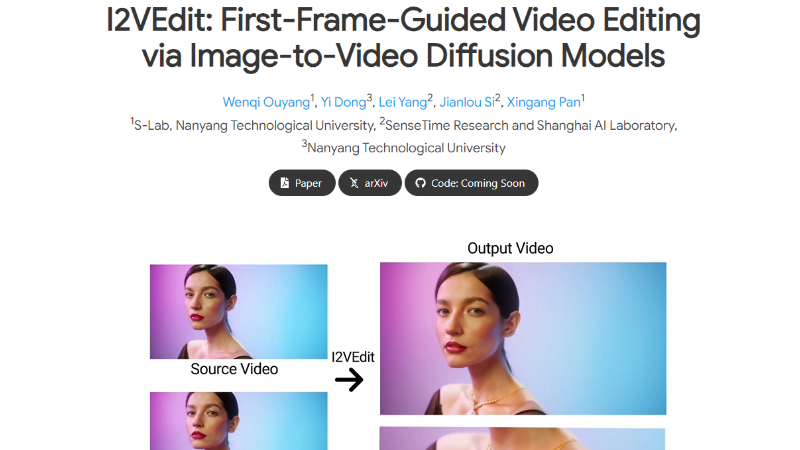

I2VEdit:南洋理工和商汤科技联合推出的一款视频编辑框架

I2VEdit简介

I2VEdit是由南洋理工大学和商汤科技研究院共同开发的一种创新视频编辑框架。该框架利用图像到视频的扩散模型,实现了以第一帧图像编辑为引导的全自动视频编辑流程。用户只需使用图像编辑工具处理视频的第一帧,I2VEdit便能够智能地将这些编辑扩展至整个视频序列,同时保持视觉内容和运动轨迹与原视频的一致性。这一技术突破显著提升了视频编辑的灵活性和效率,使得视频编辑工作能够像处理图像一样简便快捷。

I2VEdit主要功能

- 首帧编辑引导:用户可以通过图像编辑工具对视频的第一帧进行编辑,I2VEdit会将这些编辑应用到整个视频序列中。

- 视觉和运动保持:在编辑过程中,I2VEdit能够保持视频的原始外观和动态特征,确保编辑后的视频中物体的动作和外观与原视频一致。

- 适应性编辑:能够根据编辑的幅度和类型(如全局编辑、局部编辑或适度的形状变化),自适应地调整编辑的强度和范围。

- 高质量输出:生成的视频在视觉上连贯且质量高,无论是细节还是整体风格都与编辑的第一帧保持一致。

I2VEdit技术原理

- 粗略运动提取:通过训练一个运动LoRA(Low-Rank Adaptation)模型来捕捉视频中的大致运动模式,确保编辑后的视频在运动上与原视频保持一致。

- 外观细化:使用细粒度的注意力匹配技术,通过空间注意力差异图的计算和多阶段时间注意力注入,精确调整生成视频的外观和动态。

- 间隔跳过策略:采用间隔跳过策略来减少长视频编辑过程中质量的下降,通过跨多个视频片段的自回归生成来提高视频质量。

- 平滑区域随机扰动(SARP):为了改善具有大面积平滑区域的视频的编辑质量,通过在源视频的平滑区域添加随机扰动来提高逆向采样的质量。

- 基于预训练模型:I2VEdit基于预训练的图像到视频扩散模型,利用这些模型将编辑从单一帧传播到整个视频序列。

- 注意力机制:在整个视频生成过程中,使用注意力机制来对视频帧进行细粒度的调整,确保编辑的一致性和准确性。

I2VEdit应用场景

- 电影和视频制作:电影制作人可以使用I2VEdit快速对视频片段进行特效编辑和风格调整,提升后期制作的效率。

- 社交媒体内容创作:内容创作者可以利用I2VEdit在社交视频中实现个性化编辑,如更改服装颜色、添加特效等,丰富视觉表现。

- 广告制作:广告设计师可以应用I2VEdit进行广告视频的快速原型设计和编辑,实现产品展示的多样化视觉效果。

- 教育和培训视频:教育机构可以利用I2VEdit来增强教学视频,如突出显示教学重点、模拟实验过程等,提高学习材料的吸引力。

- 虚拟现实和游戏:开发者可以使用I2VEdit生成或编辑游戏内视频内容,如动态背景、剧情动画等,提升游戏体验。

- 新闻和报道:新闻机构可以应用I2VEdit快速编辑新闻视频,如调整色调、模拟场景重现等,以增强报道的视觉冲击力。

I2VEdit项目入口

- 官方项目主页:https://i2vedit.github.io/

- arXiv研究论文:https://arxiv.org/abs/2405.16537

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号