FlexGen:香港科技大学推出的多视图图像生成框架

FlexGen简介

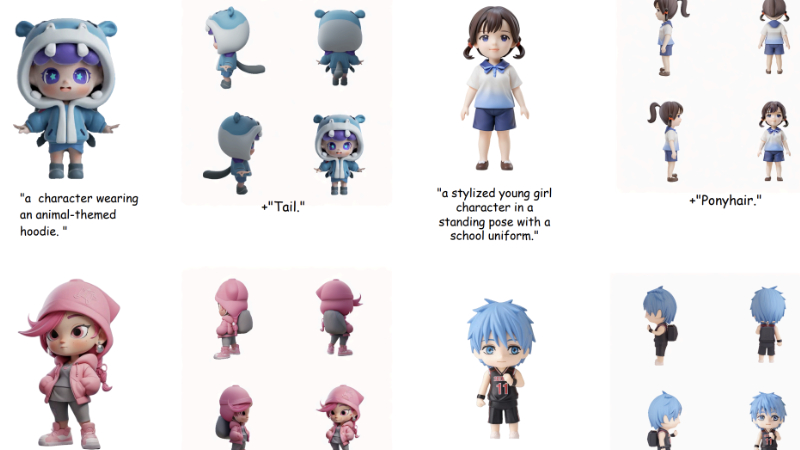

FlexGen是由香港科技大学(HKUST)的研究团队开发的一种创新的多视图图像生成框架,它能够根据单一视图图像或文本提示生成可控和一致的多视图图像。该框架通过利用GPT-4V的强推理能力,生成包含3D空间关系的文本注释,从而实现对生成图像的精确控制。FlexGen不仅支持编辑未见区域和修改材质属性,而且在游戏开发、动画和虚拟现实等领域具有广泛的应用潜力。

FlexGen主要功能

- 多视图图像生成:根据单一视图图像或文本提示生成一致的多视图图像。

- 可控性:用户可以通过修改文本提示来控制生成的图像内容,包括补充未见区域和调整材质属性。

- 材质编辑:允许用户通过文本提示调整生成图像的金属感和粗糙度等材质属性。

- 3D空间关系理解:利用GPT-4V生成包含3D空间信息的文本注释,以增强生成图像的3D一致性。

- 灵活的输入条件:支持基于文本、图像或两者结合的条件生成,提供灵活的生成选项。

FlexGen技术原理

- 3D-aware文本注释:使用GPT-4V分析对象的四个正交视图,生成包含3D空间关系的详细描述性文本注释。

- 自适应双控模块:通过参考注意力机制整合参考图像和文本提示,实现对多视图图像生成的精确联合控制。

- 跨模态交互:利用交叉注意力机制促进图像和文本之间的信息交互,以生成与输入一致的图像。

- 条件切换器:在训练期间引入条件切换器,支持单模态和双模态输入条件,以适应不同的输入场景。

- 预训练模型:基于大型预训练的文本到图像扩散模型,利用2D扩散模型的先验知识生成多视图图像。

- 数据集构建:构建包含多视图图像和对应的3D-aware全球-局部文本注释的数据集,以支持训练和生成过程。

- 材质渲染集成:在文本注释中加入材质描述,如金属感和粗糙度,以实现材质可控的生成。

FlexGen应用场景

- 游戏开发:FlexGen可以快速生成游戏角色和环境的多视图图像,加速3D模型的设计和开发过程。

- 计算机动画:在动画制作中,该框架能够根据文本描述生成连贯的多视图角色和场景,提高动画创作的效率。

- 虚拟现实(VR):为虚拟现实应用创建详细的3D环境和对象,提供沉浸式体验所需的高质量视觉效果。

- 增强现实(AR):在AR应用中,根据文本提示生成的多视图图像可以用来设计互动元素,增强用户与虚拟内容的互动。

- 3D打印:用户可以通过FlexGen设计3D模型,生成多角度视图,以用于3D打印和原型制作。

- 在线广告和营销:快速生成产品模型的多视图图像,用于在线广告和营销材料,提升产品展示的吸引力和专业性。

FlexGen项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号