AnimateAnything:能够实现对视频内容的精确和一致性操控

AnimateAnything简介

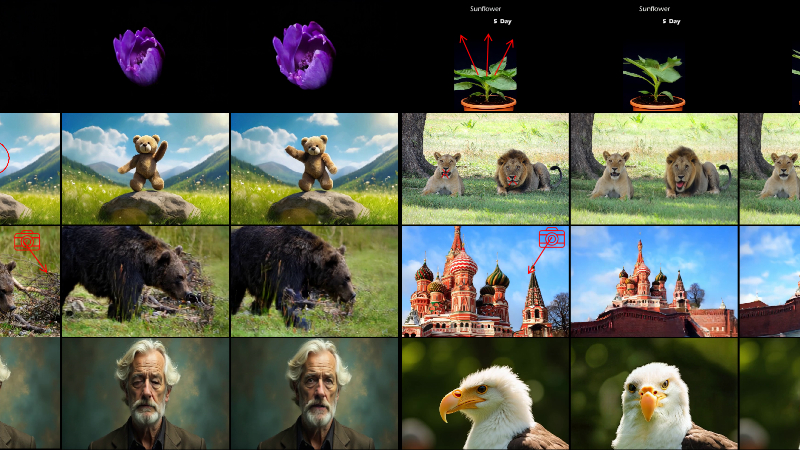

AnimateAnything是由浙江大学CAD&CG国家重点实验室、清华大学、北京航空航天大学和浙江工商大学联合开发的先进视频生成技术。这项技术能够实现对视频内容的精确和一致性操控,包括相机轨迹、文本提示和用户运动注释等多种条件。通过将所有控制信号转换为逐帧光流,并结合频域特征稳定化技术,AnimateAnything能够生成高质量且稳定的视频内容,显著提升了视频生成的灵活性和实用性。

AnimateAnything主要功能

- 统一可控视频生成:能够在多种条件下,如不同的相机轨迹、文本提示和用户运动注释,实现精确和一致的视频内容操控。

- 多尺度控制特征融合:设计了一个多尺度控制特征融合网络,用于构建不同条件下的共同运动表示。

- 光流引导的视频生成:将所有控制信息转换为逐帧光流,作为运动先验来指导最终的视频生成。

- 频率域稳定性增强:通过频域特征修改来增强视频的时间连贯性,减少大规模运动引起的闪烁问题。

- 两阶段视频生成流程:首先将控制信号统一为逐帧光流,然后在第二阶段用于生成与参考图像和注释语义对齐的高质量视频。

- 自适应特征细化:在频域中进行自适应特征细化,有效抑制生成视频中的不稳定性。

AnimateAnything技术原理

- 视频扩散模型:基于图像扩散概率模型,扩展到时间维度,通过学习逆向噪声添加过程来生成连续且高质量的视频内容。

- 光流作为统一表示:将局部主体运动和全局相机运动统一为逐帧像素运动的表示,即光流,以支持视频生成模型的行为指导。

- 显式和隐式控制信号注入:根据控制信号的特性,设计了显式和隐式注入模块,将信号转换为光流,以实现统一的光流生成。

- 频域转换和光谱注意力机制:将特征从时域转换到频域,并引入光谱注意力机制来提高生成视频的整体质量。

- 自适应频域特征修改:通过快速傅里叶变换(FFT)提取频域特征,并对其进行修改,以保持视频生成过程中场景特征的时间一致性。

- 多条件网络训练策略:使用不同的数据集进行训练,包括室内静态场景和动态场景,以实现多条件可控网络训练。

AnimateAnything应用场景

- 电影制作:AnimateAnything可以用于电影制作中,通过精确控制视频内容,如角色动作和相机运动,来创造复杂的场景而无需实际拍摄。

- 虚拟现实(VR):在虚拟现实应用中,该技术可以用来生成与用户互动一致的动态环境,提升沉浸式体验。

- 游戏开发:游戏开发者可以利用AnimateAnything生成逼真的动画和背景视频,增强游戏的视觉效果和动态交互。

- 视频编辑:视频编辑软件可以集成此技术,让用户通过简单的控制信号轻松编辑和生成复杂的视频内容。

- 广告制作:在广告行业中,AnimateAnything能够根据广告需求快速生成吸引人的视频动画,提高制作效率。

- 教育和培训:该技术可以用于创建教育视频,如模拟实验或历史事件,提供生动的学习材料,增强学习体验。

AnimateAnything项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号