SlideChat:上海人工智能实验室领衔开发的视觉语言助手

SlideChat简介

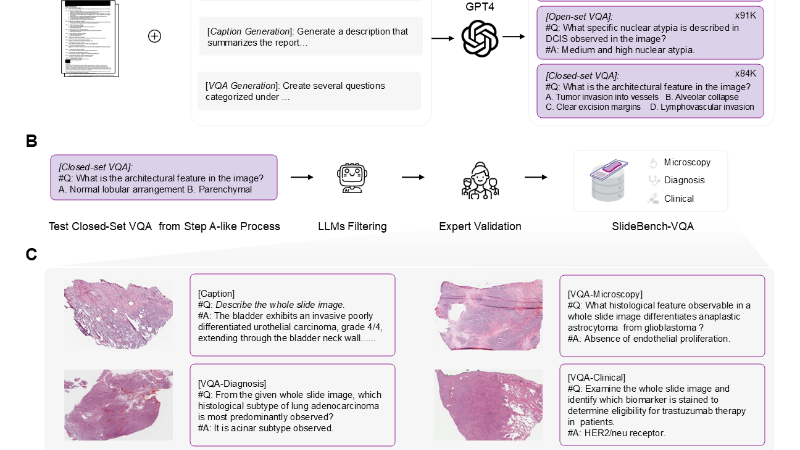

SlideChat是由上海人工智能实验室领衔开发的一个创新视觉语言助手,它能够理解和分析千兆像素级别的全幻灯片病理图像。这一工具通过结合大规模多模态指令数据集SlideInstruction和多模态基准测试SlideBench,展现出在多种病理场景中进行复杂对话和响应指令的能力,为计算病理学领域提供了一个强大的开放资源,以促进研究和发展。

SlideChat主要功能

- 全幻灯片图像理解:SlideChat能够处理和理解千兆像素级别的全幻灯片图像(WSIs),提供对病理图像的全局理解。

- 多模态对话能力:该工具能够参与涉及病理图像的复杂对话,理解和响应与图像内容相关的自然语言查询。

- 响应复杂指令:SlideChat能够执行和响应在病理诊断和研究中遇到的多样化和复杂的视觉指令。

- 临床任务覆盖:它能够在多种临床设置中执行任务,如显微镜检查、诊断和治疗指导。

- 数据集和基准测试:提供了SlideInstruction数据集和SlideBench基准测试,用于训练和评估模型性能。

SlideChat技术原理

- 补丁级编码器:将全幻灯片图像分割成小块(补丁),每个补丁由补丁级编码器单独处理以提取局部特征。

- 幻灯片级编码器:使用幻灯片级编码器(如LongNet)来增强补丁级特征,并捕获整个幻灯片的全局模式。

- 稀疏注意力机制:幻灯片级编码器采用稀疏注意力机制来聚合局部和全局上下文信息。

- 多模态投影层:将视觉特征映射到与大型语言模型(LLM)对齐的统一空间,确保视觉特征与文本数据的有效整合。

- 大型语言模型(LLM):处理自然语言指令,并将文本输入与从WSIs提取的视觉特征整合,生成准确的、上下文相关的诊断响应。

- 两阶段训练方法:

- 跨域对齐:对齐LLM的词嵌入与从WSI提取的视觉特征,使LLM能够解释视觉表示。

- 视觉指令学习:进一步训练模型以准确响应特定于WSI的领域问题。

-

开源资源:SlideChat、SlideInstruction和SlideBench均作为开源资源发布,以促进计算病理学的研究和开发

SlideChat应用场景

- 病理诊断辅助:SlideChat可以辅助病理学家分析数字化组织样本,如全幻灯片图像,提供诊断支持。

- 罕见癌症检测:利用其高级视觉语言能力,SlideChat能够识别和预测罕见癌症类型及其生物标志物。

- 教育和培训:在医学教育中,SlideChat可以作为教学工具,帮助学生理解复杂的病理学概念和图像。

- 临床决策支持:在临床设置中,SlideChat能够提供基于图像的决策支持,帮助医生制定治疗计划。

- 研究和药物开发:在药物研究和开发中,SlideChat可以分析病理图像数据,加速新药的发现和开发过程。

- 自动化病理报告生成:SlideChat能够自动从病理图像中提取关键信息,生成标准化的病理报告,提高报告编写效率。

SlideChat项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号