MIDI:能够从单张图片生成具有多个3D实例的完整场景

MIDI简介

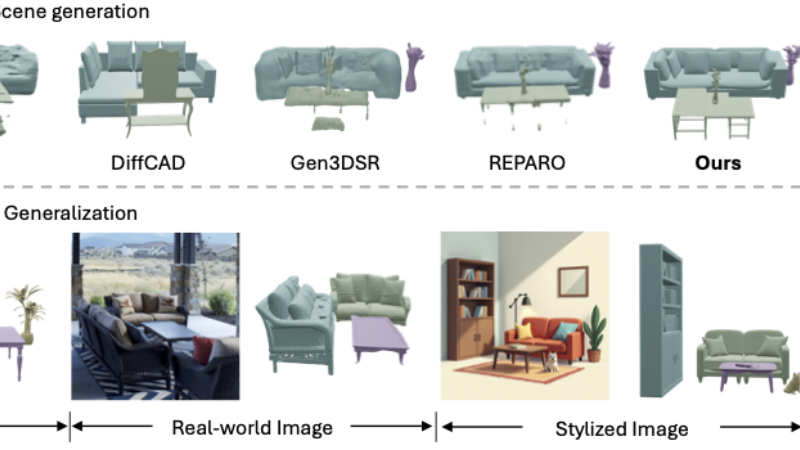

MIDI是一种创新的3D场景生成框架,它通过扩展预训练的图像到3D对象生成模型到多实例扩散模型,并引入多实例注意力机制,能够从单张图片中同时生成多个具有精确空间关系的3D实例。这种方法不仅提高了生成效率,还增强了场景的准确性和一致性,展现出在图像到场景生成任务中的突破性性能。MIDI在合成数据、真实世界图像以及风格化图像上的实验结果均表明其在3D场景生成领域具有强大的泛化能力和先进的性能。

MIDI主要功能

- 3D场景生成:MIDI能够从单张图片生成具有多个3D实例的完整场景。

- 空间关系建模:准确捕捉并模拟场景中各个3D实例之间的空间关系。

- 高泛化能力:在合成数据、真实世界图像和风格化图像上均展现出良好的性能。

- 端到端生成:无需复杂的多步骤处理,直接从图像生成3D场景。

MIDI技术原理

- 多实例扩散模型:扩展预训练的图像到3D对象生成模型,使其能够同时处理多个3D实例。

- 多实例注意力机制:通过这种机制,模型能够在生成过程中直接捕捉对象间的交互和空间一致性。

- 部分对象图像和全局场景上下文输入:模型结合部分对象图像和全局场景上下文,直接在3D生成过程中建模对象补全。

- 有效的监督和正则化:在训练过程中,使用有限的场景级数据监督3D实例之间的交互,同时结合单对象数据进行正则化,以保持预训练模型的泛化能力。

- 端到端的3D生成流程:通过生成所有实例的同时保持空间一致性,避免了中间步骤累积错误的问题。

- 预训练模型的利用:MIDI基于大规模预训练的3D对象生成模型,这些模型在多样化的数据集上训练,具有强大的3D先验和泛化能力。

MIDI应用场景

- 虚拟现实(VR)和增强现实(AR):在VR和AR应用中,MIDI可以快速从2D图像生成3D场景,提升用户体验。

- 游戏开发:游戏设计师可以利用MIDI从概念艺术或现有图像创建3D游戏环境,提高开发效率。

- 电影和动画制作:在电影和动画制作中,MIDI能够根据概念图快速生成3D场景,加速场景构建过程。

- 室内设计和建筑可视化:设计师可以使用MIDI从平面图或照片生成3D室内布局,进行更直观的设计展示。

- 教育和培训模拟:MIDI可以创建教育所需的3D模型和场景,用于模拟训练和教学展示。

- 电子商务:在线零售商可以利用MIDI技术,让消费者通过上传图片来预览产品在实际环境中的效果。

MIDI项目入口

- 项目主页:https://huanngzh.github.io/MIDI-Page/

- GitHub代码库:https://github.com/huanngzh/MIDI

- arXiv研究论文:https://arxiv.org/pdf/2412.03558

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号