CosyVoice 2:阿里推出的先进流式语音合成模型

CosyVoice 2简介

CosyVoice 2是由阿里巴巴集团开发的先进流式语音合成模型,它通过整合大型语言模型,实现了在流式模式下人类水平的自然度和几乎无损的合成质量。该模型以其有限标量量化技术、简化的文本到语音语言模型架构,以及支持多样化合成场景的块感知因果流匹配模型而著称,能够提供低延迟、高一致性的语音输出。

CosyVoice 2主要功能

- 流式语音合成:支持实时语音合成,适用于需要即时反馈的应用场景,如在线语音聊天。

- 多语种支持:通过大规模多语种数据集训练,支持包括中文、英文、日语和韩语在内的多种语言。

- 高自然度:在流式模式下实现与人类相似的语音自然度。

- 指令性语音合成:能够根据情感、口音、角色风格等指令生成具有特定特征的语音。

- 细粒度控制:支持对语音输出进行细粒度控制,如语速、语调、特定词汇的强调等。

- 零拍摄能力:无需特定说话者的数据,即可合成特定说话者的语音。

CosyVoice 2技术原理

- 有限标量量化(FSQ):用于提高语音标记的码本利用率,通过量化技术捕捉更多的语音信息。

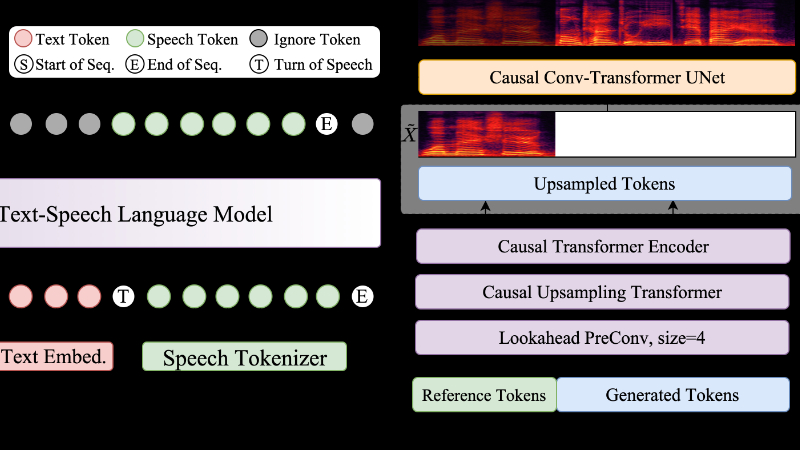

- 预训练语言模型(LLM):简化文本-语音语言模型架构,直接使用预训练的LLM作为主干网络,增强上下文理解。

- 块感知因果流匹配模型:支持流式和非流式合成,通过条件流匹配模型将语音标记转换为Mel频谱。

- 语义和声学信息分离:独立建模语音信号的语义和声学信息,提高合成的灵活性和控制性。

- 统一的流式/非流式框架:允许在单一模型内进行流式和非流式语音合成,简化部署和应用。

- 指令集成:将指令和零拍摄能力集成到单一模型中,实现更多样化和生动的语音合成。

- 多说话者微调(mSFT):在多个说话者上进行微调,以提高特定说话者的合成质量和相似性。

- 强化学习:用于微调阶段,通过ASR系统和说话者相似性作为奖励函数,优化说话者相似性和发音准确性。

CosyVoice 2应用场景

- 虚拟助手:为用户提供实时语音交互的虚拟助手,如智能音箱和智能手机中的语音助手。

- 有声读物:自动将电子书籍或文章转换成有声书,提供自然流畅的朗读体验。

- 客户服务:在客户服务系统中,用以生成自然语音回复,提升客户体验。

- 语言学习:辅助语言学习应用,提供标准发音和语言练习的语音反馈。

- 视频配音:为视频内容自动生成配音,尤其是在需要多语种支持的国际化视频制作中。

- 游戏角色配音:在电子游戏中为角色生成逼真的语音,增强游戏的沉浸感和互动性。

CosyVoice 2项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号