MV-Adapter:生成在不同视角下一致的图像

MV-Adapter简介

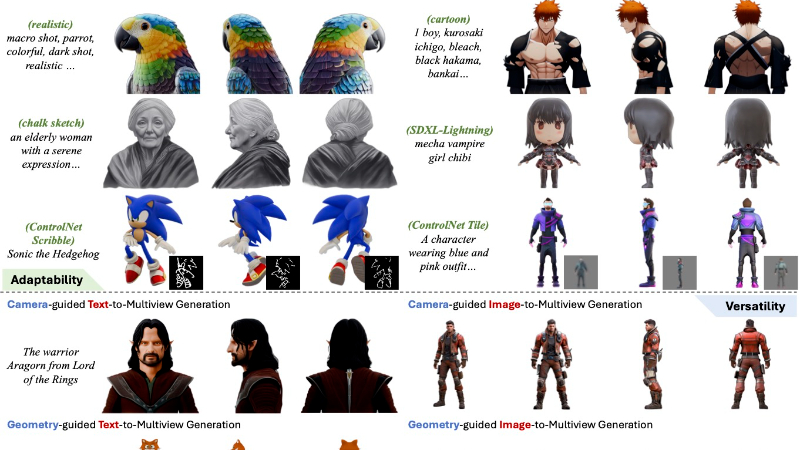

MV-Adapter是由北京航空航天大学软件学院、VAST以及上海交通大学的研究团队共同开发的一种创新适配器,旨在简化多视图一致图像的生成过程。它作为一种多功能的即插即用适配器,能够将现有的预训练文本到图像(T2I)扩散模型转化为能够生成多视图图像的生成器,而无需改变原始网络结构或特征空间。通过仅更新少量参数,MV-Adapter实现了高效的训练,同时保留了预训练模型中的先验知识,减少了过拟合的风险,并能够高效地建模3D几何知识。

MV-Adapter主要功能

- 多视图图像生成: MV-Adapter能够将预训练的文本到图像(T2I)模型扩展为多视图图像生成器,生成在不同视角下一致的图像。

- 即插即用适配器: 作为一种插件式适配器,MV-Adapter可以轻松集成到各种T2I模型中,无需对原始模型结构进行修改。

- 参数效率: 通过仅更新少量参数,MV-Adapter实现了高效的训练过程,同时保留了预训练模型的先验知识。

- 3D几何知识建模: 引入创新设计,使适配器能够有效地建模3D几何知识,支持3D生成和纹理生成等应用。

- 条件编码器: 通过统一的条件编码器整合相机参数和几何信息,增强模型在文本和图像基础上的3D生成能力。

MV-Adapter技术原理

- 解耦的注意力机制: MV-Adapter设计了一种解耦的注意力机制,通过复制原始的自注意力层来创建新的多视图注意力层和图像交叉注意力层,确保新层能够继承预训练层的强大先验。

- 平行注意力架构: 新的注意力层与原始的自注意力层平行组织,确保新层可以充分利用预训练层的图像先验,有效学习几何知识。

- 条件引导器: 设计了一个通用的条件引导器来编码相机或几何信息,支持相机引导和几何引导的多视图生成。

- 多视图扩散模型: 通过引入多视图注意力机制,MV-Adapter增强了T2I模型,使得生成的图像能够在不同视图中保持一致性。

- 训练和推理: 在训练期间,只有MV-Adapter的权重会被优化,而预训练的T2I模型权重保持冻结。这种训练方法允许MV-Adapter在不同条件下生成多视图一致的图像。

MV-Adapter应用场景

- 3D内容创作: 利用MV-Adapter生成多视图图像,辅助3D艺术家和设计师在不同角度下创建和编辑3D模型。

- 机器人感知: 在机器人视觉系统中,MV-Adapter可以用于生成多视角图像,帮助机器人更好地理解和交互环境。

- 虚拟现实(VR): 在虚拟现实应用中,MV-Adapter能够为虚拟环境提供一致的多视角渲染,增强用户体验。

- 增强现实(AR): MV-Adapter可以用于生成与现实世界物体一致的多视角图像,为AR应用提供更加真实的交互效果。

- 游戏开发: 在游戏设计中,MV-Adapter可以用于快速生成游戏角色和环境的多视角图像,加速游戏资产的制作流程。

- 模拟与训练: MV-Adapter可以生成多视角的训练图像,用于模拟训练场景,如驾驶训练、军事演习等,提供更全面的视角训练。

MV-Adapter项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号