OpenEMMA:开源的多模态自动驾驶模型

OpenEMMA简介

OpenEMMA是由德州农工大学、密歇根大学和多伦多大学的研究团队共同开发的开源端到端自动驾驶框架。该框架基于多模态大型语言模型(MLLMs),通过链式思考推理过程,显著提升了自动驾驶系统在复杂场景下的性能。OpenEMMA不仅能够有效处理视觉数据和驾驶场景推理,还整合了优化的YOLO模型以提高3D边界框检测的准确性。其代码已在GitHub上公开,以促进更广泛的研究和开发。

OpenEMMA主要功能

- 端到端自动驾驶框架:OpenEMMA提供从传感器输入到驾驶决策的完整处理流程,无需传统的模块化架构。

- 多模态数据处理:结合视觉数据(如摄像头图像)和车辆历史状态信息,进行综合分析。

- 链式思考推理:通过模仿人类驾驶时的思考过程,生成关于速度向量和曲率向量的中间表示,进而计算出车辆的未来轨迹。

- 3D对象检测:集成优化的YOLO模型,提高对道路上物体的3D边界框检测的准确性。

- 开源代码:所有代码在GitHub上公开,便于研究社区进行利用、改进和扩展。

OpenEMMA技术原理

- 基于MLLMs的框架:利用预训练的多模态大型语言模型(MLLMs)处理复杂的视觉数据和驾驶场景。

- 视觉问题回答(VQA):将驾驶任务框架化为VQA问题,通过链式思考推理过程指导模型生成详细的对象描述和驾驶决策。

- 速度和曲率向量生成:模型预测未来几秒内的速度向量和曲率向量,这些向量用于计算最终的轨迹。

- 数值积分方法:使用数值积分方法(如累积梯形规则)来从速度分量计算轨迹。

- 对象检测增强:通过集成一个专门优化的YOLO模型来提高3D边界框检测的准确性,尤其是在自驾车场景中。

- 人类可解释的输出:利用MLLMs的预训练世界知识,生成可解释、可读的感知任务输出,提高透明度和可用性。

OpenEMMA应用场景

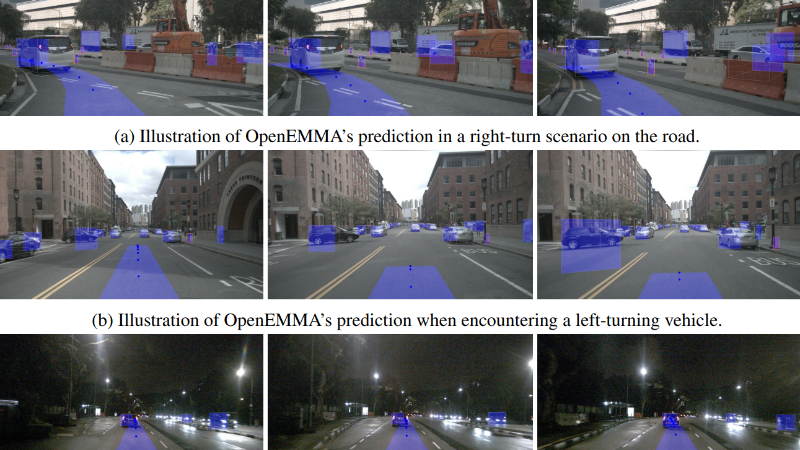

- 城市道路驾驶:在复杂的城市交通环境中,OpenEMMA能够处理多变的交通流量和不可预测的行人行为,实现安全导航。

- 高速公路巡航:在高速公路上,OpenEMMA可以维持车辆稳定行驶,并处理车道变换、速度调整等任务。

- 夜间驾驶:即使在低光照条件下,OpenEMMA也能识别关键物体并规划精确的行驶轨迹,确保夜间行车安全。

- 复杂天气条件:在雨、雾等恶劣天气下,OpenEMMA能够维持车辆的正常行驶,通过其先进的视觉处理能力减少能见度影响。

- 紧急情况响应:面对突然闯入车辆或行人等紧急情况,OpenEMMA能够迅速做出反应,采取制动或避让措施,避免事故。

- 自动泊车:在停车场环境中,OpenEMMA可以辅助或完全接管泊车任务,识别停车位并精确操控车辆停入车位。

OpenEMMA项目入口

- GitHub代码库:https://github.com/taco-group/openemma

- arXiv研究论文:https://arxiv.org/pdf/2412.15208

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号