Aria-UI:能够将自然语言指令定位到GUI中的特定元素

Aria-UI简介

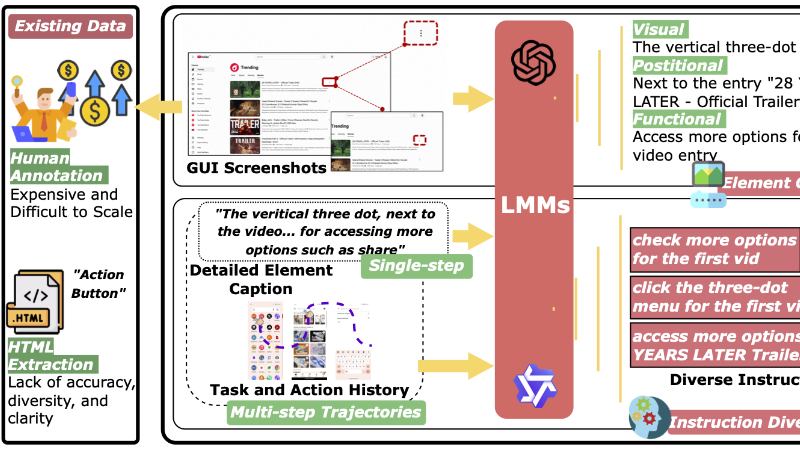

Aria-UI是一个专为图形用户界面(GUI)指令的视觉基础定位而设计的新型大型多模态模型。它采用纯视觉方法,不依赖于HTML或AXTree等辅助输入,通过一个可扩展的数据管道合成多样化和高质量的指令样本,以适应不同的规划指令。Aria-UI结合了文本和图文交织的动作历史,以处理任务执行中的动态上下文,从而在离线和在线代理基准测试中取得了新的最佳结果,超越了仅视觉和依赖AXTree的基线。该模型展示了强大的跨平台零样本泛化能力,是实现通用GUI定位的有力工具。

Aria-UI主要功能

- 视觉基础定位(Visual Grounding):Aria-UI能够将自然语言指令定位到GUI中的特定元素。

- 多模态处理:结合视觉和语言信息,处理涉及GUI元素的复杂任务。

- 数据管道合成:通过数据管道合成多样化和高质量的指令样本,以适应不同的规划指令。

- 动态上下文处理:利用文本和图文交织的动作历史,处理任务执行中的动态上下文。

- 跨平台性能:在不同的平台(如网页、桌面和移动设备)上执行任务,展示跨平台的泛化能力。

- 零样本泛化:在未见过的界面和任务上展示出色的零样本泛化性能。

Aria-UI技术原理

- 纯视觉方法:不依赖于HTML或AXTree输入,而是完全基于视觉信息进行定位。

- 数据合成管道:

- 使用强大的多模态模型(LMM)生成详细的元素描述。

- 利用语言模型(LLM)基于这些描述创建多样化的人类指令。

- 上下文感知扩展:

- 利用公开的代理轨迹数据模拟具有上下文的定位任务。

- 构建文本动作历史和图文交织历史,提供丰富的上下文线索。

- 多模态MoE模型:基于Aria模型,一个具有3.9B激活参数的最先进的多模态Mixture-of-Experts模型。

- 超高分辨率支持:扩展图像处理能力,以支持更高分辨率的GUI图像。

- 训练和推理范式:

- 使用单步定位数据训练基础GUI定位能力。

- 使用上下文感知数据进一步增强动态设置下的定位能力。

- 在推理时输出归一化的像素坐标,适应动态环境。

- 零样本学习:在没有见过的任务和界面上,Aria-UI能够利用其训练中学到的知识进行有效的定位。

Aria-UI应用场景

- 自动化网页交互:Aria-UI可以自动执行网上购物、填写表单等网页任务,无需人工介入。

- 移动应用操作:在移动设备上,Aria-UI能够根据指令自动完成应用内的各种操作,如预订票务或浏览社交媒体。

- 桌面环境自动化:在桌面环境中,Aria-UI可以用于自动化日常的电脑任务,比如文件管理或应用程序设置。

- 专业工作流自动化:Aria-UI可以集成到专业软件中,自动化复杂的工作流程,提高工作效率。

- 客户服务自动化:在客户服务领域,Aria-UI可以通过自动化GUI操作来快速响应客户的查询和请求。

- 测试与质量保证:Aria-UI可以用于自动化软件测试,通过模拟用户交互来检测应用程序的缺陷和性能问题。

Aria-UI项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号