LLM2LLM:提升大型语言模型在特定任务上的性能

LLM2LLM简介

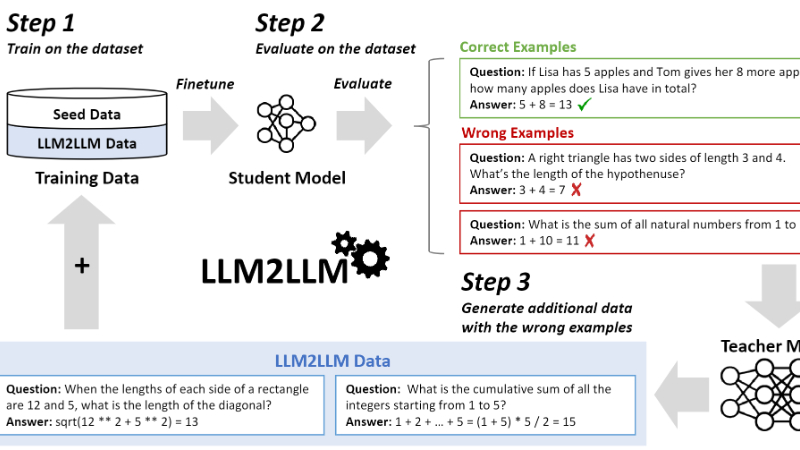

LLM2LLM是一种创新的、迭代的数据增强策略,由加州大学伯克利分校的研究团队开发。该策略通过利用一个教师型大型语言模型(LLM)来增强小型种子数据集,以便于在特定任务上对一个学生型LLM进行微调。LLM2LLM通过识别学生模型在初始数据上的错误,并基于这些错误数据点生成合成数据,从而显著提升LLM在低数据环境下的性能。这种方法减少了对人工数据标注的依赖,为处理数据受限领域和任务提供了一种可扩展且高效的LLM解决方案。

LLM2LLM主要功能

- 数据增强:使用教师模型基于学生模型在初始种子数据上的错误生成合成数据,以增强训练数据集。

- 性能提升:在低数据环境下显著提高学生模型在特定任务上的性能。

- 减少人工数据标注:减少对人工数据收集、清洗和标注的依赖,降低成本和时间消耗。

- 迭代学习:通过反复迭代训练和数据增强过程,逐步提升模型性能。

- 针对性训练:专注于模型预测错误的数据点,生成更多挑战性样本,提高模型的泛化能力。

LLM2LLM技术原理

- 预训练模型微调:在初始种子数据上微调学生模型,以适应特定任务。

- 错误分析:评估学生模型在训练数据上的表现,识别并提取模型预测错误的数据点。

- 合成数据生成:利用教师模型生成与错误数据点概念相似但语义不同的新数据点。

- 迭代数据增强:将生成的合成数据添加回训练数据集,进行下一轮的微调,以此迭代过程逐步提升模型性能。

- 数据过滤和质量保证:使用正则表达式和ROUGE分数等方法过滤和确保合成数据的质量。

- 针对性数据生成:根据学生模型在特定任务上的错误,教师模型生成针对性的合成数据,以强化模型在这些领域的性能。

- 模型从零开始微调:在每次迭代中,从预训练模型开始微调,而不是继续前一次微调的模型,以避免过拟合并找到更好的优化解。

- 多模型兼容性:框架可以与不同的教师模型和学生模型兼容,以适应不同的性能和资源需求。

LLM2LLM应用场景

- 医疗诊断辅助:在医疗领域,LLM2LLM可以用来增强特定疾病的诊断模型,通过生成合成的病例数据来提高模型的识别准确率。

- 法律文档分析:在法律行业,LLM2LLM可以帮助模型更好地理解法律文档和案例,通过增强训练数据集来提升模型对法律条文和案例的解析能力。

- 客户服务聊天机器人:在客户服务领域,LLM2LLM可以用于提升聊天机器人的理解能力,通过增强对话数据集来改善机器人的响应质量和准确性。

- 情感分析:在社交媒体监测中,LLM2LLM可以增强情感分析模型,通过生成合成的评论数据来提高模型对正面和负面情感的识别能力。

- 智能教育:在教育技术中,LLM2LLM可以用于创建个性化学习内容,通过增强题目和答案数据集来提供更多样化的教学材料。

- 自然语言理解测试:在语言技术研究中,LLM2LLM可以用于增强自然语言理解测试集,通过生成合成的语言样本来测试和改进语言模型的性能。

LLM2LLM项目入口

- Github代码库:https://github.com/SqueezeAILab/LLM2LLM

- arXiv技术论文:https://arxiv.org/pdf/2403.15042

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号