Uni-AdaFocus:能够准确地识别视频中的人类行为、事件等元素

Uni-AdaFocus简介

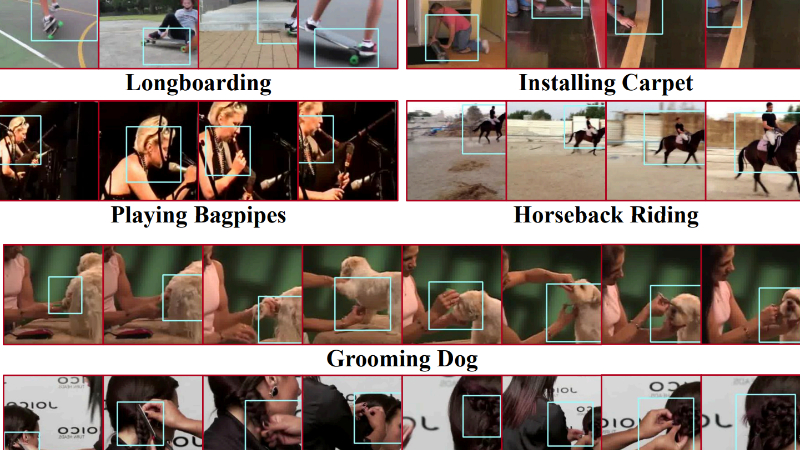

Uni-AdaFocus是由清华大学自动化系、深圳国际研究生院以及中国移动研究院的研究团队共同开发的一种视频识别技术。该技术通过空间-时间动态计算,有效减少了视频数据中的冗余信息,从而显著提高了视频理解的计算效率。Uni-AdaFocus能够自适应地关注视频帧中最相关的区域,将大量计算资源集中在这些关键区域,同时对不同视频帧和样本进行动态计算分配,以实现高效的端到端训练和硬件友好性。这一创新方法在多个基准数据集和实际应用场景中均展现出卓越的性能,为视频识别领域带来了新的突破。

Uni-AdaFocus主要功能

-

视频识别:Uni-AdaFocus能够高效、准确地识别视频中的人类行为、事件等元素,适用于视频推荐、监控和内容搜索等应用场景。

-

动态计算分配:通过动态分配计算资源,Uni-AdaFocus能够在保持高准确率的同时,显著降低计算成本和功耗。

-

端到端训练:该方法支持端到端训练,简化了模型的训练过程,提高了训练效率。

-

硬件友好性:Uni-AdaFocus在现代GPU设备上执行效率高,能够充分利用硬件资源进行并行计算。

Uni-AdaFocus技术原理

-

空间动态计算:

-

轻量级全局编码器:首先使用轻量级编码器快速处理整个视频序列,获取全局特征。

-

策略网络:利用全局特征,策略网络动态选择每个视频帧中最相关的区域。

-

高容量局部编码器:对选定的区域进行高精度推理,减少不必要的计算开销。

-

可变形补丁机制:该机制允许模型适应不同尺度、形状和位置的任务相关区域,提高了计算效率。

-

-

时间动态计算:

-

动态帧采样:通过动态帧采样算法,Uni-AdaFocus能够将大部分计算资源分配给最相关的视频帧,进一步减少时间冗余。

-

序列加权采样:策略网络为每个视频帧生成权重,并进行加权采样,以选择最有信息量的帧进行处理。

-

-

样本动态计算:

-

条件退出机制:对于相对“简单”的视频,减少计算量,而对于“困难”的视频,增加计算量,实现样本级别的动态计算分配。

-

熵阈值判断:通过比较每个帧的预测熵与预定义阈值,决定是否提前终止推理,从而节省计算资源。

-

-

端到端训练:

-

辅助监督:在训练过程中,附加线性分类器对全局和局部特征进行监督,促进模型学习更有效的特征表示。

-

多样性增强:通过随机裁剪补丁,增加局部编码器的输入多样性,提高模型的泛化能力。

-

停止梯度:在策略网络的输入处停止梯度回传,避免干扰全局编码器的学习,确保训练稳定性。

-

Uni-AdaFocus应用场景

-

视频内容推荐:通过高效识别视频中的行为和事件,为用户推荐相关视频,提升用户体验。

-

视频监控:实时监控视频流,自动识别异常行为或事件,提高安全性和监控效率。

-

内容搜索:快速准确地搜索视频中的特定内容,如特定动作或场景,方便用户查找所需视频。

-

医疗影像分析:用于分析大脑磁共振成像(MRI)数据,辅助诊断阿尔茨海默病和帕金森病等疾病。

-

体育动作分析:精细识别体育动作,如跳水、体操等,用于训练和比赛分析。

-

在线视频暴力识别:自动检测视频中的暴力行为,用于内容审核和安全监控,保障网络环境的健康。

Uni-AdaFocus项目入口

- GitHub代码库:https://github.com/LeapLabTHU/Uni-AdaFocus

- arXiv技术论文:https://arxiv.org/pdf/2412.11228

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号