GameFactory:能够生成多样化的游戏场景

GameFactory简介

GameFactory是由香港大学和快手科技联合开发的一个创新框架,旨在利用生成式交互视频技术创建全新的游戏体验。该框架通过预训练的视频扩散模型和多阶段训练策略,实现了从开放域视频数据到可控游戏场景的转换,解决了现有方法在场景泛化上的不足。开发团队通过构建高质量的GF-Minecraft数据集,为模型提供了多样化的动作标注数据,使其能够学习并模拟复杂的玩家交互行为。GameFactory不仅支持无限长度的自回归视频生成,还具备强大的场景泛化能力,为未来AI驱动的游戏开发和通用世界模型的研究开辟了新的道路。

GameFactory主要功能

-

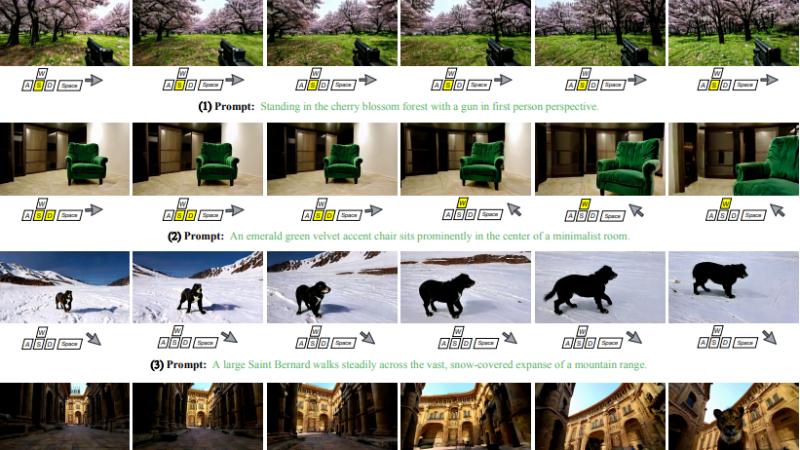

开放域场景泛化:GameFactory能够生成多样化的游戏场景,不仅限于特定游戏风格或已有的游戏场景,而是可以扩展到任何预训练模型涵盖的开放域场景,为创建全新游戏提供了广阔的可能性。

-

动作可控的交互式视频生成:通过动作控制模块,GameFactory可以将玩家的键盘和鼠标操作转化为游戏视频中的角色动作,实现与游戏环境的实时交互,支持复杂的动作组合和连续操作。

-

无限长度的自回归视频生成:该框架支持自回归生成机制,能够基于已生成的视频内容逐步扩展新的帧,从而生成无限长度的游戏视频,满足实际游戏应用中对连续性体验的需求。

-

高质量的游戏内容生成:借助预训练的视频扩散模型,GameFactory能够生成高质量、逼真的游戏视频,同时保持与文本提示的语义一致性,确保生成内容符合玩家的期望。

-

数据集构建与扩展:通过GF-Minecraft数据集,GameFactory为动作控制模块提供了高质量的训练数据,支持多样化的游戏场景和动作标注,为模型的泛化能力提供了基础。

GameFactory技术原理

-

预训练视频扩散模型:

GameFactory基于预训练的视频扩散模型,这些模型通过大规模开放域视频数据训练,学习到丰富的生成先验知识,能够生成多样化的视频内容。预训练模型为开放域场景泛化提供了基础。 -

多阶段训练策略:

为了将动作控制能力融入预训练模型,GameFactory采用多阶段训练策略:-

Phase #1:通过LoRA(低秩适配)微调预训练模型,使其适应游戏视频风格。

-

Phase #2:冻结预训练参数,仅训练动作控制模块,专注于动作控制能力的学习。

-

Phase #3:在推理阶段移除LoRA权重,保留动作控制模块,实现开放域的可控生成。

-

-

动作控制模块:

GameFactory将动作控制模块集成到视频扩散模型的Transformer块中。对于连续鼠标动作和离散键盘输入,分别采用拼接(concatenation)和交叉注意力(cross-attention)机制,以实现精准的动作控制。 -

自回归生成机制:

为了生成无限长度的视频,GameFactory采用自回归生成机制。模型基于已生成的视频帧逐步生成新的帧,支持多帧生成,大大提高了生成效率,满足了游戏应用中对连续视频的需求。 -

GF-Minecraft数据集:

为了训练动作控制模块,开发团队构建了GF-Minecraft数据集。该数据集通过随机生成动作序列,避免了人类偏见,同时涵盖了多种游戏场景、天气条件和时间段,为模型提供了高质量的训练数据。 -

解耦风格与动作控制学习:

GameFactory通过多阶段训练策略,将游戏风格学习与动作控制学习解耦。这种设计使得模型能够在保持开放域泛化能力的同时,实现精准的动作控制,避免了因风格学习而导致的动作控制能力下降。

GameFactory应用场景

-

新游戏开发:快速生成多样化的游戏场景和交互内容,降低开发成本和时间。

-

游戏内容扩展:为现有游戏生成新的关卡、场景或任务,丰富游戏体验。

-

游戏测试与优化:自动生成测试场景和交互,帮助开发者发现并优化游戏中的问题。

-

个性化游戏体验:根据玩家偏好生成定制化的游戏内容,提升玩家满意度。

-

教育与培训模拟:创建模拟环境用于教育或专业培训,如驾驶模拟、应急演练等。

-

互动娱乐体验:开发互动故事或虚拟现实(VR)游戏,提供沉浸式的娱乐体验。

GameFactory项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号