MVoT:微软联合中科院推出的新型多模态推理范式

MVoT简介

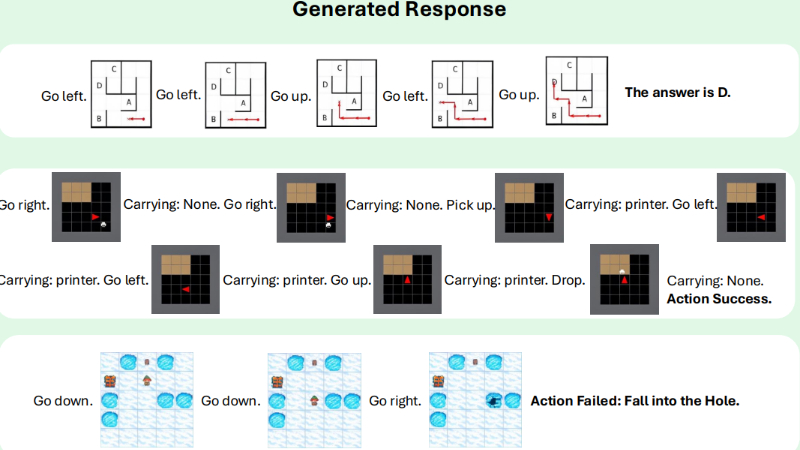

Multimodal Visualization-of-Thought(MVoT)是由微软研究院联合剑桥大学语言技术实验室和中国科学院自动化研究所共同提出的一种新型多模态推理范式。它通过在多模态大语言模型(MLLMs)中生成图像可视化推理痕迹,使模型能够以文字和图像相结合的方式进行推理,从而有效提升复杂空间推理任务的表现。开发团队在Chameleon-7B模型基础上实现了MVoT,并引入token discrepancy loss来提高可视化质量,减少视觉不连贯和失真。实验结果表明,MVoT在多个动态空间推理任务中展现出优越的适应性和鲁棒性,尤其在复杂场景下表现优于传统的Chain-of-Thought方法。

MVoT主要功能

-

增强复杂空间推理能力:MVoT通过生成图像可视化推理痕迹,使多模态大语言模型(MLLMs)能够在复杂的空间推理任务中表现出色。

-

多模态推理:MVoT结合文字和图像两种形式进行推理,提供更直观和有效的推理过程。

-

提高模型解释性:通过生成视觉和文字推理痕迹,MVoT增强了模型的可解释性,使用户能够更清晰地理解模型的推理过程。

-

鲁棒性和适应性:在面对复杂环境和任务时,MVoT展示了优越的稳定性和适应性,能够处理更复杂的空间布局和动态变化。

MVoT技术原理

-

多模态可视化推理(MVoT)框架:MVoT通过生成图像可视化推理痕迹,使模型能够在推理过程中结合文字和图像两种形式,类似于人类的认知方式。

-

自回归多模态大语言模型(MLLMs):MVoT在Chameleon-7B模型上实现,利用自回归模型生成连续的文字和图像推理痕迹。

-

token discrepancy loss:引入token discrepancy loss来弥合单独训练的tokenizer之间的差距,提升生成图像的质量,减少视觉不连贯和失真。

-

多模态序列建模:使用统一的Transformer架构处理图像和文本token序列,通过图像tokenizer和文本tokenizer将输入图像和文本转换为离散token序列,并进行因果Transformer模型处理。

-

动态空间推理任务:在实验中选择了MAZE导航、MINIBEHAVIOR中的InstallingAPrinter任务和FROZENLAKE模拟,验证MVoT在不同复杂度的空间推理任务中的有效性。

MVoT应用场景

-

自动驾驶:通过生成环境的动态可视化,帮助自动驾驶系统更好地理解复杂的交通场景,提前预测潜在的危险并做出决策。

-

机器人导航与操作:在复杂环境中,MVoT可以辅助机器人进行路径规划和物体操作,通过视觉推理优化任务执行。

-

医疗影像分析:在医学诊断中,MVoT能够生成关键部位的可视化推理,辅助医生更准确地分析影像,提高诊断效率。

-

智能教育:为学生提供直观的视觉推理过程,帮助他们更好地理解复杂的数学、物理等学科问题,提升学习效果。

-

虚拟现实与游戏开发:在虚拟环境中,MVoT可以实时生成场景的动态变化,增强用户的沉浸感和交互体验。

-

工业自动化:在工业生产中,MVoT可用于监控和优化生产流程,通过可视化推理及时发现异常并调整生产策略。

MVoT项目入口

- arXiv技术论文:https://arxiv.org/pdf/2501.07542

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号