CineMaster:快手等推出的可控且具备3D感知的视频生成框架

CineMaster简介

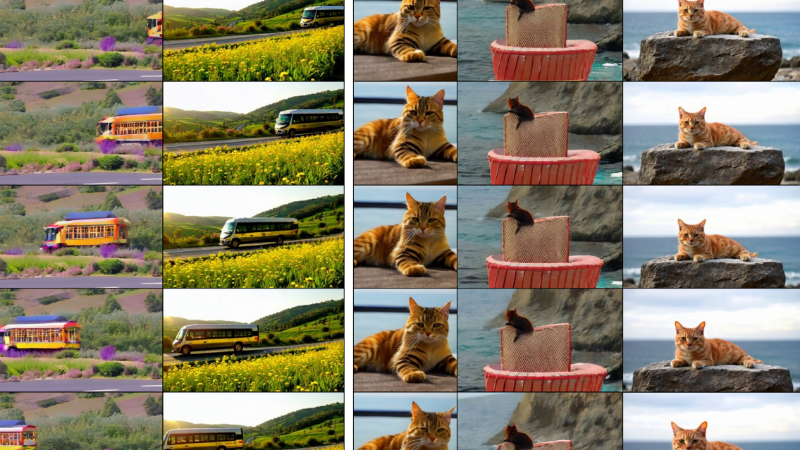

CineMaster是由大连理工大学、香港中文大学和快手科技联合开发的创新框架,旨在实现高度可控且具备3D感知能力的文字到视频生成。该框架通过两个阶段实现:首先,通过交互式工作流让用户像专业导演一样在3D空间中布置物体和相机,生成控制信号;然后,利用这些信号指导文本到视频扩散模型生成用户期望的视频内容。开发团队还设计了自动化数据标注管道,解决了3D物体运动和相机姿态标注数据稀缺的问题。CineMaster在实验中展现出卓越的3D感知能力和视频生成效果,显著优于现有方法,为影视创作和视频生成领域带来了新的突破。

CineMaster主要功能

-

3D感知的对象和相机控制:用户可以在三维空间中自由放置和操控对象与相机,实现精确的对象布局和复杂的相机运动轨迹设计,满足专业级影视创作的需求。

-

直观的交互式工作流:提供一个类似电影拍摄的交互式界面,用户可以通过定位3D边界框和定义相机运动来构建视频的场景布局,并实时预览渲染效果,进行迭代优化。

-

高质量的视频生成:利用深度图和语义信息作为条件信号,指导文本到视频扩散模型生成高质量、符合用户意图的视频内容,同时保持与文本描述的高度一致性。

-

自动化的数据标注流程:提供从大规模视频数据中提取3D边界框和相机轨迹的自动化标注工具,解决了大规模3D标注数据稀缺的问题,为模型训练提供了丰富的数据支持。

CineMaster技术原理

-

3D感知控制信号的构建

-

用户通过交互式界面在3D空间中定义对象的边界框和相机的运动轨迹。

-

系统利用Blender等3D引擎实时渲染深度图和投影图,生成精确的3D布局信息,作为后续视频生成的条件信号。

-

-

语义布局注入模块(Semantic Layout ControlNet)

-

将投影深度图与对象的类别标签融合,通过多层感知机(MLPs)将语义信息注入到扩散模型中。

-

提供精确的空间布局指导,确保生成的视频中对象的位置和运动符合用户的设计。

-

-

相机适配器(Camera Adapter)

-

在扩散模型的每个DiT块中注入相机姿态信息,通过残差连接将相机运动特征与对象运动特征解耦。

-

实现对对象运动和相机运动的联合控制,生成复杂的动态场景。

-

-

自动化数据标注流程

-

使用实例分割(如Grounding DINO + SAM 2)和深度估计(如DepthAnything V2)提取视频中的3D边界框和相机轨迹。

-

通过三维点云计算和对象跟踪,生成大规模带有3D标注的视频数据集,用于模型的训练和优化。

-

-

分阶段训练策略

-

首先在带有深度图标注的视频上训练ControlNet模块。

-

然后在3D边界框数据集上训练语义布局注入模块。

-

最后联合训练语义布局注入模块和相机适配器,实现对对象和相机运动的联合控制。

-

CineMaster应用场景

-

影视制作:导演和编剧可通过CineMaster快速生成创意镜头,辅助剧本可视化和分镜头设计,节省拍摄成本和时间。

-

广告创意:广告公司利用其强大的可控性,快速生成产品宣传视频,精准呈现产品特点和创意场景。

-

动画制作:动画师可快速构建动画场景和角色运动,生成初步动画效果,提高制作效率。

-

游戏开发:游戏开发者可快速生成游戏过场动画或场景演示,辅助游戏设计和宣传。

-

教育与培训:教师可生成教学视频,直观展示复杂场景或实验过程,增强教学效果。

-

虚拟现实(VR)与增强现实(AR):为VR/AR内容创作者提供快速生成沉浸式场景的能力,丰富用户体验。

CineMaster项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号