SpatialVLA:新型空间增强视觉-语言-动作模型

SpatialVLA简介

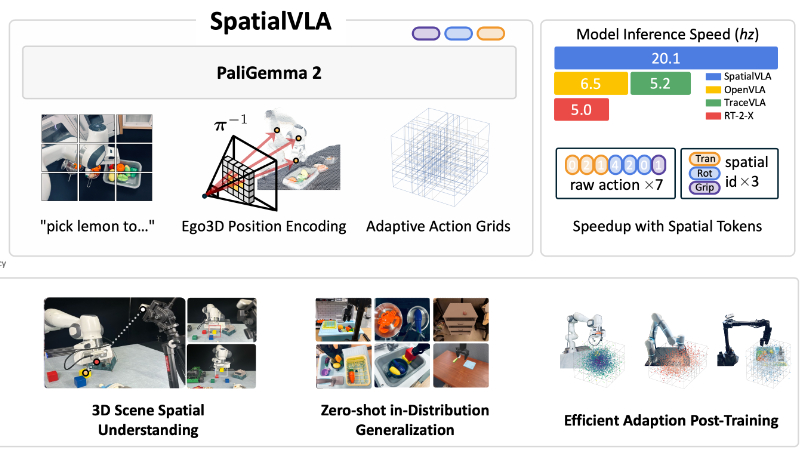

SpatialVLA是由上海人工智能实验室、上海科技大学和TeleAI联合开发的一种新型视觉-语言-行动(VLA)模型。该模型通过引入Ego3D位置编码和自适应动作网格,为机器人提供了强大的三维空间理解能力。它在110万真实机器人数据集上进行预训练,能够学习跨多种机器人环境和任务的通用操纵策略。SpatialVLA在零样本控制、新机器人设置的适应性以及空间理解能力方面展现出卓越性能,显著优于现有的VLA模型。开发团队通过创新的空间表示方法,使SpatialVLA能够更好地感知三维世界,并生成精确的机器人动作指令,为通用机器人策略的研究提供了新的方向。

SpatialVLA主要功能

-

三维空间理解与机器人控制:SpatialVLA能够通过视觉和语言指令理解三维物理世界,并生成精确的机器人动作指令,实现复杂的机器人操纵任务。

-

零样本控制(Zero-shot Control):在预训练后,SpatialVLA可以直接应用于多种机器人任务,无需额外训练,展现出强大的泛化能力。

-

新机器人设置的快速适应性:通过自适应动作网格的重新离散化,SpatialVLA能够快速适应新的机器人环境和任务,减少微调所需的资源。

-

高效的动作生成与推理速度:SpatialVLA通过离散化动作空间,将连续动作转换为空间动作标记,显著提高了模型的推理速度,降低了计算成本。

-

跨机器人泛化能力:该模型能够在不同机器人平台上运行,通过学习通用的三维空间知识,实现跨机器人的动作控制。

SpatialVLA技术原理

-

Ego3D位置编码(Ego3D Position Encoding)

-

通过深度信息和图像像素构建以机器人为中心的三维坐标系,无需特定的机器人-相机校准。

-

将三维空间信息与二维语义特征相结合,增强模型对三维场景结构的理解。

-

该编码方式适用于多种机器人设置,具有良好的泛化性。

-

-

自适应动作网格(Adaptive Action Grids)

-

将连续的机器人动作离散化为自适应的空间网格,根据动作分布统计信息划分网格。

-

学习空间动作标记,将动作表示为离散的标记类别,简化动作生成过程。

-

在新机器人设置中,通过重新离散化动作网格,快速适应新的动作空间。

-

-

大规模预训练与微调

-

在110万真实机器人数据集上进行预训练,学习通用的操纵策略。

-

预训练后,通过少量数据对模型进行微调,使其适应特定的机器人任务或环境。

-

-

视觉-语言-行动(VLA)模型架构

-

基于预训练的视觉-语言模型(如Paligemma2),结合机器人动作输出头。

-

使用自回归方式生成动作标记,并将其解码为连续动作,实现从视觉和语言输入到机器人动作的映射。

-

-

三维空间感知与动作对齐

-

通过Ego3D位置编码和自适应动作网格,将三维空间信息注入到模型的输入和输出中。

-

使模型能够理解三维空间中的物体位置和运动方向,生成与物理世界对齐的动作指令。

-

SpatialVLA应用场景

-

工业自动化:在工业生产线上,SpatialVLA可用于复杂零件的装配、物料搬运和质量检测,通过精确的空间理解实现高效、灵活的机器人操作。

-

物流与仓储:在物流中心,SpatialVLA能够控制机器人完成货物分拣、码垛和搬运任务,适应不同形状和大小的物品,提高物流效率。

-

服务机器人:在家庭或公共场所,SpatialVLA驱动的服务机器人可以执行清洁、整理物品、递送物品等任务,根据自然语言指令完成多样化服务。

-

医疗康复:在医疗领域,SpatialVLA可用于辅助康复机器人,帮助患者进行康复训练,通过精确的动作控制和空间理解提供个性化的康复方案。

-

教育与科研:在教育和科研中,SpatialVLA可用于开发机器人实验平台,支持学生和研究人员探索机器人编程、空间认知和人机交互等领域。

-

智能零售:在零售场景中,SpatialVLA驱动的机器人可以进行商品补货、货架整理和顾客引导,提升店铺运营效率和顾客体验。

SpatialVLA项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号