Open-Sora 2.0:潞晨科技推开源的SOTA视频生成模型

Open-Sora 2.0简介

Open-Sora 2.0是由潞晨科技推出的全新开源SOTA(State-of-the-Art)视频生成模型。该模型仅用20万美元的训练成本,便实现了与全球领先视频生成模型相当的性能,展现出极高的成本效益。开发团队通过优化数据策划、模型架构、训练策略和系统优化,成功降低了训练成本,同时保持了高质量的视频生成能力。Open-Sora 2.0支持文本到视频和图像到视频的生成,分辨率达到768×768像素,视频长度可达5秒。团队致力于通过开源这一模型,推动内容创作领域的创新和普及,为视频生成技术的未来发展提供新的思路和工具。

Open-Sora 2.0主要功能

-

高质量视频生成:

-

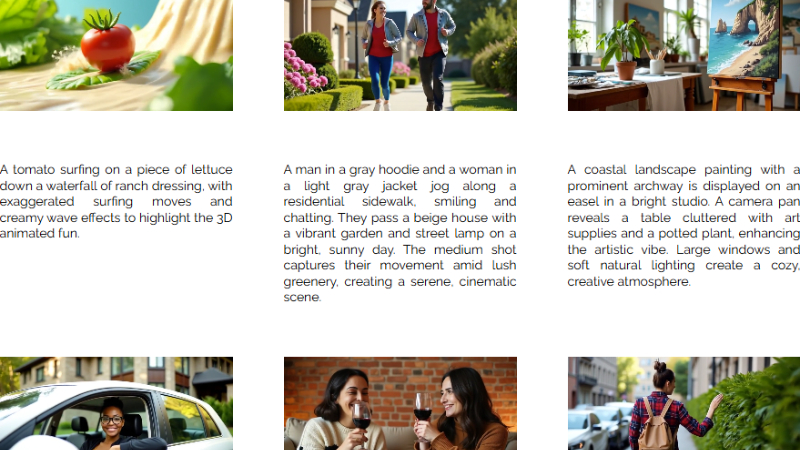

支持文本到视频(Text-to-Video)和图像到视频(Image-to-Video)生成,能够根据文本提示或图像生成高质量的视频内容。

-

支持多种视频分辨率(如256×256和768×768像素)和长达5秒的视频生成,满足不同应用场景的需求。

-

-

高效训练与推理:

-

仅用20万美元的训练成本,相比其他类似模型,成本降低5-10倍。

-

采用高效的视频自编码器(Video DC-AE)和扩散变换器(DiT架构),显著提升训练和推理速度。

-

-

灵活的条件控制:

-

支持通过运动分数(Motion Score)控制视频的动态强度,用户可以根据需求生成高动态或低动态的视频。

-

提供图像引导(Image Guidance)功能,增强视频生成的连贯性和一致性。

-

-

开源与可扩展性:

-

完全开源,提供完整的代码和资源,方便开发者进行二次开发和优化。

-

支持多种视频生成任务,如视频续写(Video-to-Video)和基于特定风格的视频生成。

-

Open-Sora 2.0技术原理

-

数据策划与过滤:

-

采用多层次数据过滤系统,通过预处理和评分过滤(如美学评分、运动评分、模糊检测等)筛选出高质量的训练数据。

-

利用开源模型(如LLaVA-Video)和专有模型(如Qwen 2.5 Max)为视频生成详细字幕,提升数据的语义丰富度。

-

-

高效的视频自编码器(Video DC-AE):

-

提出高压缩比的视频自编码器,通过增加空间压缩比,减少训练和推理时的计算量。

-

在编码器和解码器中引入残差连接,解决高压缩自编码器中的梯度传播问题。

-

-

扩散变换器(DiT架构):

-

采用全注意力机制和3D RoPE(旋转位置嵌入),增强模型对空间和时间信息的捕捉能力。

-

结合双流(双通道)和单流(单通道)处理块,提升跨模态交互效率。

-

-

高效的训练策略:

-

分阶段训练:先在低分辨率视频上训练文本到视频和图像到视频模型,再在高分辨率视频上微调。

-

利用开源图像模型(如Flux)初始化,避免从头训练图像模型的高成本。

-

采用激活检查点和自动恢复系统,优化内存使用并提升训练稳定性。

-

-

灵活的条件控制机制:

-

通过图像引导和运动分数控制视频生成的连贯性和动态强度。

-

采用动态图像引导策略和分类器自由引导(Classifier-Free Guidance),提升生成视频的质量和一致性。

-

-

系统优化:

-

使用ColossalAI框架和H200 GPU,结合Zero Redundancy Optimizer和Context Parallelism等技术,优化内存使用和计算效率。

-

通过预分配内存和异步数据传输,提升数据加载和模型保存的效率。

-

Open-Sora 2.0应用场景

-

内容创作与视频制作:快速生成高质量的视频内容,用于广告、影视、短视频等领域,降低制作成本和时间。

-

动画与特效制作:基于文本或图像生成动画片段,辅助动画师快速生成初步素材,提升创作效率。

-

教育与培训:根据教学内容生成教育视频,帮助学生更直观地理解复杂概念,例如科学实验、历史场景重现等。

-

游戏开发:生成游戏内的动态场景、角色动作或过场动画,丰富游戏内容,提升玩家体验。

-

虚拟现实(VR)与增强现实(AR):为VR/AR应用生成沉浸式的动态内容,增强用户的交互体验。

-

创意设计与艺术创作:艺术家和设计师可以利用其生成创意视频,探索新的艺术表现形式,激发灵感。

Open-Sora 2.0项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号