Step-Video-TI2V:阶跃星辰推出的图像到视频生成模型

Step-Video-TI2V简介

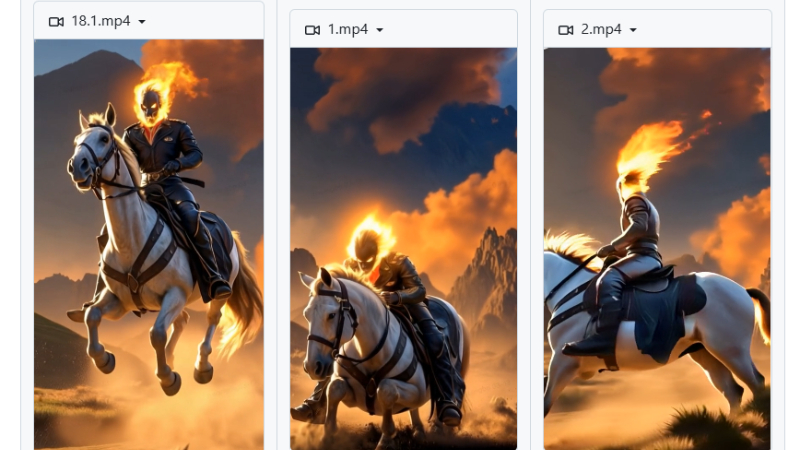

Step-Video-TI2V是由阶跃星辰开发的文本驱动图像到视频生成模型。该模型基于300亿参数的Step-Video-T2V进行预训练,通过引入图像条件和运动条件两项关键改进,能够根据文本和图像输入生成最多102帧的视频。开发团队还构建了Step-Video-TI2V-Eval基准数据集,用于评估不同TI2V模型的性能。在实验中,Step-Video-TI2V展现了卓越的性能,尤其在动漫风格的图像到视频生成任务中表现突出。此外,该模型还提供了对视频动态水平的显式控制,赋予用户更大的创作灵活性。Step-Video-TI2V及其评估数据集均已开源,为视频生成领域的研究和应用提供了有力支持。

Step-Video-TI2V主要功能

-

文本驱动的图像到视频生成:能够根据用户提供的文本描述和图像输入,生成与之匹配的视频内容。例如,用户输入一张人物图像和描述“人物在海边奔跑”,模型可以生成一段人物在海边奔跑的视频。

-

运动动态控制:用户可以通过设置运动分数超参数,直接控制生成视频的动态水平。例如,用户可以选择生成高动态(如快速运动、复杂场景变换)或低动态(如缓慢运动、稳定场景)的视频。

-

动漫风格视频生成优势:由于训练数据中动漫风格视频占比较大,该模型在生成动漫风格视频时表现尤为出色,能够更好地捕捉动漫元素的动态和风格特点。

-

高帧率视频生成:支持生成最多102帧的视频,能够满足多种视频内容创作的需求,提供更流畅的视觉效果。

Step-Video-TI2V技术原理

-

基于预训练模型的改进:Step-Video-TI2V并非从零开始训练,而是基于Step-Video-T2V(一个300亿参数的开源文本到视频模型)进行预训练,并针对图像到视频生成任务进行了适应性改进。

-

图像条件编码:将输入图像添加随机高斯噪声后,通过Step-Video-T2V的Video-VAE将其编码为潜在表示,并与视频潜在表示沿通道维度拼接,从而将图像作为生成视频的第一帧。

-

运动条件嵌入:通过OpenCV计算视频帧之间的光流,提取光流幅度的最高值并计算其平均值作为运动分数。在自适应层归一化(AdaLN-Single)过程中,将运动分数嵌入到时间步嵌入中,使用户能够在推理时通过设置运动分数超参数来控制视频的动态水平。

-

多维度评估与优化:通过构建Step-Video-TI2V-Eval基准数据集,从指令遵循性、主体和背景一致性、对物理定律的遵循性等多个维度对模型性能进行评估和优化,以提升生成视频的质量和相关性。

Step-Video-TI2V应用场景

-

动漫制作:快速生成动漫风格的视频片段,辅助动漫创作者完成初步的动画制作,节省时间和成本。

-

广告创意:根据产品图像和广告文案生成动态视频广告,为广告设计提供创意灵感和初步素材。

-

视频内容创作:帮助视频博主或自媒体创作者根据主题图像和描述快速生成视频内容,丰富创作素材。

-

教育与培训:将教育主题的图像和文字描述转化为生动的视频,用于制作教学课件或在线课程,提高学习趣味性。

-

游戏开发:生成游戏中的动画场景或角色动作视频,辅助游戏开发者进行游戏动画的设计和优化。

-

社交媒体:为社交媒体用户提供个性化的视频生成服务,根据用户上传的图片和文字描述生成有趣的视频,增强用户互动性。

Step-Video-TI2V项目入口

- Github代码库:https://github.com/stepfun-ai/Step-Video-TI2V

- HuggingFace:https://huggingface.co/stepfun-ai/stepvideo-ti2v

- arXiv技术论文:https://arxiv.org/pdf/2503.11251

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号