MoCha:Meta等推出的端到端对话角色视频生成模型

MoCha简介

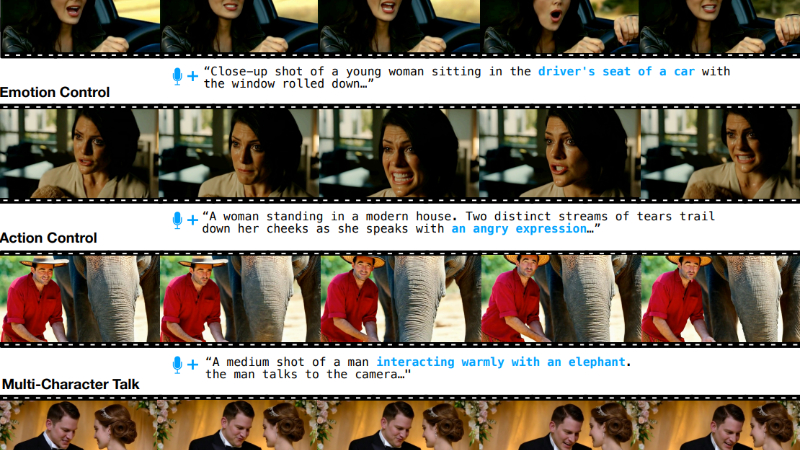

MoCha是由Meta和滑铁卢大学联合开发的端到端对话角色视频生成模型。它仅需语音和文本输入,无需额外辅助条件,即可生成电影级的多角色对话动画。MoCha通过语音-视频窗口注意力机制实现了精准的语音与视频对齐,并采用联合训练策略,利用语音标注和文本标注的视频数据,显著提升了模型的泛化能力。此外,MoCha还支持多角色轮换对话,能够生成具有情感表达和全身动作的角色动画。在MoChaBench基准测试中,MoCha在口型同步、表情自然度、动作自然度等多维度上均展现出卓越性能,为AI生成的叙事视频树立了新的行业标准。

MoCha主要功能

-

端到端对话角色视频生成:MoCha能够直接从语音和文本输入生成高质量的对话角色视频,无需额外的辅助条件(如参考图像、骨骼关键点等),简化了模型架构,提高了动作的多样性和泛化能力。

-

多角色对话支持:首次实现了多角色轮换对话的连贯生成,支持电影级、故事驱动的视频合成,允许AI生成的角色在上下文感知的对话中自然切换。

-

精准语音与视频对齐:通过语音-视频窗口注意力机制,MoCha能够显著提高口型同步的准确性和语音与视频的对齐效果,使角色的口型和语音高度一致。

-

全身动作生成:MoCha不仅关注面部表情和口型,还能生成自然流畅的全身动作,使角色的动作与对话内容和场景描述相匹配。

-

文本驱动的场景控制:用户可以通过文本提示详细描述角色的外观、动作、场景环境等,MoCha能够根据这些文本提示生成与描述一致的视频内容。

MoCha技术原理

-

扩散变换器(DiT)架构:MoCha基于扩散变换器(Diffusion Transformer)架构,通过将文本和语音条件依次通过交叉注意力机制融入模型,有效捕捉语义和时间动态。

-

语音-视频窗口注意力机制:为了解决视频压缩和并行生成带来的语音-视频对齐问题,MoCha引入了语音-视频窗口注意力机制。该机制限制每个视频令牌只能关注与其时间上相邻的音频令牌,从而提高口型同步的准确性和语音-视频对齐效果。

-

联合训练策略:由于大规模语音标注视频数据稀缺,MoCha采用了联合训练策略,同时利用语音标注和文本标注的视频数据进行训练。这种策略增强了模型在多样化角色动作上的泛化能力,并通过自然语言提示实现对角色表情、动作、互动和环境的精细控制。

-

结构化提示模板:为了简化多角色对话的文本描述,MoCha设计了结构化提示模板,通过为每个角色分配唯一标签并在文本中使用这些标签来描述角色的动作和互动。这种设计减少了冗余,提高了模型在多角色场景中的生成效果。

-

多阶段训练框架:MoCha采用了多阶段训练框架,根据镜头类型(如特写镜头、中景镜头)对数据进行分类,并逐步引入更复杂的任务。这种训练方式确保了模型在不同难度任务上的表现,同时提高了训练效率。

MoCha应用场景

-

电影和动画制作:快速生成角色动画原型,降低制作成本,提高创作效率。

-

虚拟助手和客服:创建具有自然表情和动作的虚拟形象,提升用户体验。

-

在线教育:生成生动的教学视频,使内容更具吸引力和互动性。

-

广告和营销:制作个性化、富有表现力的广告视频,吸引观众注意力。

-

游戏开发:快速生成游戏中的角色动画和对话场景,丰富游戏内容。

-

社交媒体内容创作:帮助创作者轻松生成有趣、个性化的视频内容,提升内容的多样性和吸引力。

MoCha项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号