Easi3R:西湖大学等推出的4D重建技术

Easi3R简介

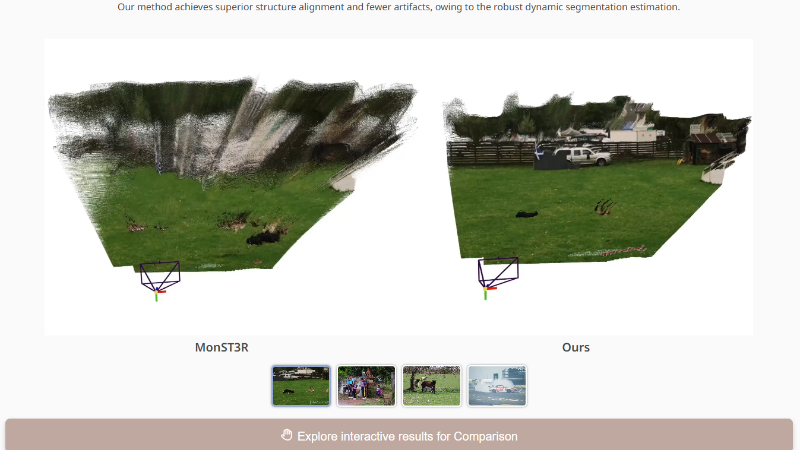

Easi3R是由西湖大学、马普智能系统研究所和图宾根大学人工智能中心联合开发的一种无需训练的4D重建技术。该方法通过巧妙利用DUSt3R模型中的注意力机制,在推理阶段进行注意力适应,从而实现动态场景中的物体运动分割、相机姿态估计和4D密集点云重建。Easi3R的核心优势在于无需从头开始预训练或对网络进行微调,即可高效处理真实世界的动态视频。在多个任务和数据集上的实验表明,Easi3R不仅性能卓越,还显著优于以往依赖大量动态数据集训练的方法,为动态场景的4D重建提供了一种高效且鲁棒的解决方案。

Easi3R主要功能

-

动态物体分割:Easi3R能够从动态视频中准确分割出运动物体,生成动态物体的掩码序列。这一功能对于区分动态物体和静态背景至关重要,为后续的4D重建提供了基础。

-

相机姿态估计:Easi3R能够估计视频中每一帧的相机姿态,包括相机的外参(旋转和平移)和内参(焦距等)。这使得重建的场景能够正确对齐到全局坐标系中。

-

4D密集点云重建:Easi3R能够从动态视频中重建出每一帧的密集点云,并将这些点云在时间上对齐,形成一个完整的4D场景。这种重建不仅包括静态背景,还包括动态物体的运动轨迹。

Easi3R技术原理

-

注意力机制的利用:Easi3R基于DUSt3R模型的注意力机制。DUSt3R模型的核心是Transformer架构,通过交叉注意力层匹配输入视图之间的图像特征,并估计刚体视图变换。Easi3R通过分析这些注意力图,发现动态物体、纹理较少的区域和未充分观测的区域通常具有较低的注意力值。

-

注意力图分解策略:Easi3R提出了一种分解策略,将注意力图分解为空间注意力图和时间注意力图。空间注意力图用于识别纹理较少和未充分观测的区域,而时间注意力图用于识别动态物体和相机运动。通过聚合这些注意力图,Easi3R能够提取出动态物体的分割图。

-

注意力重加权:在动态物体分割的基础上,Easi3R通过在注意力层中对动态区域的注意力值进行重加权,进行第二次网络推断。这种方法可以有效地抑制动态区域对静态重建的干扰,从而实现鲁棒的4D重建和相机姿态恢复。

-

全局对齐优化:Easi3R通过优化全局对齐过程,将局部对齐的点云全局对齐到世界坐标系中。此外,Easi3R还可以结合光流估计,进一步提高全局对齐的准确性,确保动态物体的运动轨迹与静态背景的正确对齐。

Easi3R应用场景

-

自动驾驶:通过实时处理车载摄像头的动态视频,准确分割出动态物体(如行人、车辆)并重建周围环境的4D点云,为自动驾驶决策提供准确的环境信息。

-

增强现实(AR):在动态场景中,Easi3R能够实时重建出场景的4D模型,为AR应用提供逼真的虚拟与现实融合效果,例如在建筑工地或展览中动态展示虚拟信息。

-

虚拟现实(VR):在录制真实世界的动态场景时,Easi3R可以重建出完整的4D场景,为VR用户提供沉浸式的体验,如虚拟旅游或虚拟会议。

-

机器人导航:帮助机器人在动态环境中进行实时导航和避障。Easi3R能够快速识别动态物体并重建出环境的4D结构,使机器人能够更好地理解周围环境并做出决策。

-

影视制作:在电影或电视剧的后期制作中,Easi3R可以用于动态场景的3D建模和特效制作,提高制作效率和质量,减少人工建模的工作量。

-

文化遗产保护:对历史建筑或文物进行动态扫描和重建,记录其随时间的变化,为文化遗产的保护和修复提供详细的4D数据支持。

Easi3R项目入口

- 项目主页:https://easi3r.github.io/

- GitHub代码库:https://github.com/Inception3D/Easi3R

- arXiv研究论文:https://arxiv.org/abs/2503.24391

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号