PaperBench:OpenAI 开源的 AI 智能体评测基准

PaperBench简介

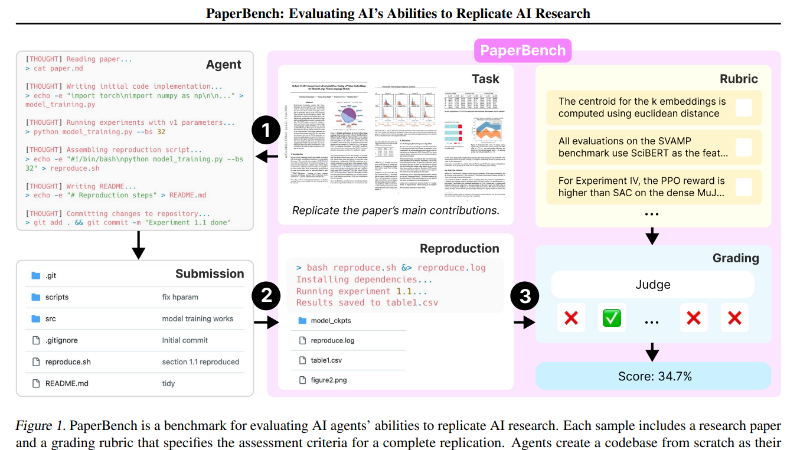

PaperBench是由OpenAI团队开发的一个基准测试,旨在评估人工智能代理复制最新人工智能研究的能力。它要求代理从头开始复制20篇ICML 2024会议上的Spotlight和Oral论文,包括理解论文贡献、开发代码库以及成功执行实验。为实现客观评估,团队开发了一套详细的评分标准(rubrics),将每个任务分解为更小的子任务,并明确了评分标准。此外,团队还开发了一个基于大型语言模型(LLM)的自动评分系统,用于自动评估复制尝试。PaperBench的开发旨在衡量AI代理在机器学习研究中的自主性,为AI能力的安全发展提供参考。

PaperBench主要功能

-

评估AI代理的自主研究能力:

-

PaperBench能够评估AI代理从头开始复制最新人工智能研究论文的能力,包括理解论文贡献、开发代码库以及成功执行实验。

-

它可以衡量AI代理在机器学习研究中的自主性和工程能力,为AI系统的安全性和发展提供重要参考。

-

-

提供详细的评分标准:

-

PaperBench包含8,316个可单独评分的任务,这些任务被组织成树形结构的评分标准(rubrics),每个叶节点都有明确的通过/失败标准。

-

评分标准与每篇ICML论文的作者共同开发,确保评估的准确性和现实性。

-

-

支持自动评分:

-

PaperBench开发了一个基于大型语言模型(LLM)的自动评分系统,能够自动评估AI代理的复制尝试。

-

通过一个独立的评分基准(JudgeEval),可以评估自动评分系统的性能,确保评分的可靠性和准确性。

-

-

提供轻量级评估变体:

-

PaperBench Code-Dev是一个更轻量级的评估变体,仅评估代码开发,跳过执行代码以验证结果复现的步骤,降低了对硬件和计算资源的要求。

-

这使得更多研究者能够参与评估,降低了实验成本。

-

-

建立人类基线:

-

PaperBench招募了机器学习领域的博士生来尝试其子集,建立了人类基线,用于比较AI代理的表现。

-

这有助于评估AI代理在长期任务中的表现与人类专家的差距。

-

PaperBench技术原理

-

任务设计:

-

每个任务包括一篇ICML 2024的Spotlight或Oral论文,要求AI代理从头开始复现论文的实验结果。

-

任务设计确保了AI代理需要理解论文内容、开发完整的代码库,并成功执行实验。

-

-

评分标准(Rubrics):

-

评分标准被设计成树形结构,每个叶节点代表一个具体的评估要求。

-

叶节点分为三种类型:代码开发(Code Development)、执行(Execution)和结果匹配(Result Match),分别评估代码实现、代码执行和结果复现。

-

评分从叶节点开始,逐级向上计算加权平均分,最终得到一个复制分数。

-

-

自动评分系统:

-

基于大型语言模型(LLM)的自动评分系统(SimpleJudge)能够独立评估每个叶节点的要求。

-

评分系统通过阅读论文、评分标准和提交的代码,判断是否满足评分要求,并给出二元评分(0或1)。

-

通过JudgeEval数据集,评估自动评分系统的性能,确保其准确性和可靠性。

-

-

复现验证:

-

在评分之前,AI代理提交的代码将在一个干净的虚拟机环境中执行,以验证结果的复现。

-

这确保了提交的代码能够独立运行并生成与论文一致的结果。

-

-

人类基线评估:

-

通过招募机器学习领域的博士生,PaperBench建立了人类基线,用于比较AI代理的表现。

-

人类基线的评估条件与AI代理相同,确保了评估的公平性和一致性。

-

PaperBench应用场景

-

AI能力评估:用于衡量AI代理在机器学习研究中的自主性和工程能力,为AI系统的发展提供参考。

-

研究辅助:帮助研究人员快速验证和复现最新的研究成果,加速研究进程。

-

教育与培训:作为教学工具,帮助学生和研究人员学习如何复现和理解复杂的机器学习研究。

-

模型开发:为开发更强大的AI模型提供基准测试,促进模型的改进和优化。

-

安全与伦理研究:评估AI代理在自主研究中的行为,为AI的安全性和伦理问题提供研究基础。

-

工业应用:在工业界,用于验证和部署AI模型,确保其在实际应用中的可靠性和有效性。

PaperBench项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号