DreamActor-M1:字节跳动推出的人类图像动画框架

DreamActor-M1简介

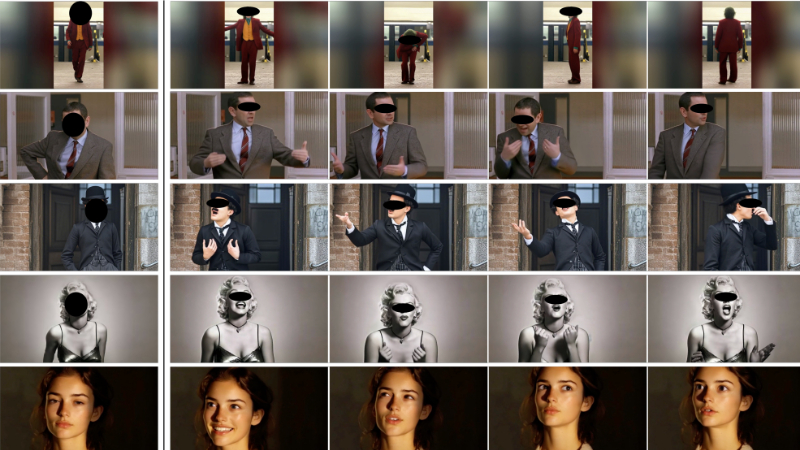

DreamActor-M1是由字节跳动智能创作团队开发的一款人类图像动画框架。该框架基于扩散变换器(DiT),通过混合引导信号实现了整体性、表现力和鲁棒性的人类图像动画。它结合了隐式面部表示、3D头部球体和3D身体骨骼等混合控制信号,能够精细地控制面部表情和身体动作,同时保持身份特征的连贯性。此外,DreamActor-M1还采用了渐进式训练策略,支持从肖像到全身视图的多尺度合成,并通过补充外观引导解决了复杂运动中未见区域的长期时间连贯性问题。该框架在多尺度适应性、细粒度控制和长期一致性方面表现出色,为人类图像动画领域带来了新的突破。

DreamActor-M1主要功能

-

整体性人类图像动画生成:

-

实现从肖像到全身视图的多尺度适应性,支持不同场景下的人类动画生成。

-

生成的动画能够保持角色的身份特征,同时实现面部表情和身体动作的精细控制。

-

-

细粒度表情和动作控制:

-

通过混合引导信号(隐式面部表示、3D头部球体和3D身体骨骼)实现对微妙面部表情和复杂身体动作的精确控制。

-

支持通过语音信号驱动面部表情(如唇部同步),进一步扩展了动画的应用场景。

-

-

长期时间连贯性:

-

在复杂运动期间,通过补充外观引导确保未见区域(如衣物背面)的视觉连贯性。

-

采用多参考协议,增强多视角和长期视频生成的稳定性和一致性。

-

-

多场景适应性:

-

支持多种场景,包括舞蹈、体育、电影场景和演讲等,具有广泛的适用性。

-

通过渐进式训练策略,模型能够适应不同分辨率和尺度的输入数据。

-

DreamActor-M1技术原理

-

混合引导信号:

-

隐式面部表示:通过预训练的面部运动编码器将面部表情编码为隐式表示,能够更好地捕捉微妙的面部表情细节,并实现面部表情、身份和头部姿势的解耦。

-

3D头部球体:独立控制头部姿势,通过渲染一个与驱动视频中的头部位置和方向一致的3D球体,提供头部旋转的视觉线索。

-

3D身体骨骼:通过估计身体和手部参数,构建2D图像平面上的身体骨骼图,用于控制身体动作和骨骼长度调整。

-

-

渐进式训练策略:

-

分为三个阶段:

-

第一阶段:仅使用3D身体骨骼和3D头部球体进行训练,避免复杂信号干扰模型学习。

-

第二阶段:引入隐式面部表示,训练面部运动编码器和注意力层,专注于学习面部表情细节。

-

第三阶段:解冻所有模型参数,进行全面训练,优化整体性能。

-

-

-

补充外观引导:

-

在训练阶段,通过选择具有最大、最小和中等z轴旋转角度的关键帧作为参考,增强模型对多尺度、多视图和长期视频生成的能力。

-

在推理阶段,通过生成多视图视频序列,然后将最有信息量的帧重新注入模型作为补充外观引导,提高空间和时间连贯性。

-

-

多参考协议:

-

在推理阶段,支持单参考图像和多参考图像两种模式。多参考模式通过生成伪参考图像,增强模型对未见区域的视觉信息,从而提高长期视频生成的质量和一致性。

-

-

基于扩散变换器(DiT)的框架:

-

使用预训练的3D变分自编码器(VAE)进行潜在空间训练,结合MMDiT作为骨干网络,通过3D自注意力层和空间交叉注意力层实现参考图像和视频帧之间的信息交互。

-

DreamActor-M1应用场景

-

影视制作:用于生成虚拟角色的动画,降低制作成本,提高制作效率,还可以通过动画预览帮助导演更好地规划拍摄。

-

广告行业:快速生成具有吸引力的动态广告,展示产品特点和使用场景,提升广告的吸引力和影响力。

-

视频游戏:创建逼真的游戏角色动画,增强游戏的沉浸感和真实感,同时支持玩家自定义角色动画。

-

虚拟现实(VR)和增强现实(AR):为虚拟环境中的角色提供自然流畅的动画,提升用户体验,增强虚拟场景的真实感。

-

在线教育:制作生动的教学视频,通过动画讲解复杂的知识点,提高学生的学习兴趣和理解能力。

-

社交媒体和娱乐:用户可以将自己的照片制作成有趣的动画视频,分享到社交媒体平台,增加娱乐性和互动性。

DreamActor-M1项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号