LAM:从单张图像中重建出一个可动画化的高斯头像

LAM项目简介

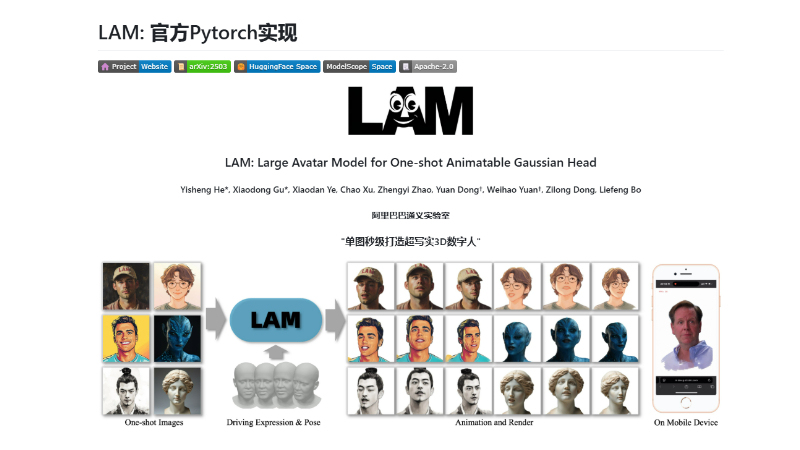

LAM(Large Avatar Model)是由阿里巴巴集团通义实验室开发的一种创新的高斯头像生成技术,它可以从单张图像生成可动画化的高斯头像。LAM的核心优势在于其能够在单次前向传递中直接生成可动画化和渲染的头像,无需额外的神经网络或后处理步骤,从而实现了在各种平台(包括移动设备)上的实时动画和渲染。该技术利用FLAME模型的规范点作为查询,结合Transformer架构,通过与多尺度图像特征的交互来准确预测高斯属性。LAM不仅在重建质量和纹理保真度上优于现有方法,还支持从文本提示或单张图像生成和编辑可动画化的高斯头像,具有广泛的应用前景。

LAM主要功能

-

单张图像生成可动画化的高斯头像:LAM能够从单张图像中重建出一个可动画化的高斯头像,无需额外的训练数据或复杂的后处理步骤。

-

实时动画和渲染:生成的高斯头像可以直接在各种平台上进行实时动画和渲染,包括移动设备,支持流畅的交互体验。

-

无缝集成到现有渲染管线:LAM生成的头像可以无缝集成到传统的渲染管线中,无需修改现有的渲染流程,便于在不同平台上部署。

-

文本到头像生成:支持从文本提示生成高质量的高斯头像,用户可以通过简单的文本描述来创建个性化的头像。

-

风格化编辑:用户可以对生成的头像进行风格化编辑,例如改变年龄、风格或表情,生成多样化的头像风格。

LAM技术原理

-

规范化高斯头像生成:

-

使用FLAME模型的规范顶点作为初始点位置,通过点云表示形状,充分利用FLAME模型中的先验形状信息,简化重建挑战。

-

所有高斯头像在规范空间中重建,具有相同的表情和姿势,便于推理时的动画制作,同时减少了形状和姿势的多样性,降低了重建的复杂性。

-

-

多尺度图像特征提取:

-

利用预训练的Vision Transformer(ViT)从单张图像中提取多尺度特征,捕捉局部细节(如头发、皱纹)和全局相似性。

-

通过交叉注意力机制,将点云特征与图像特征相结合,提高重建质量和纹理保真度。

-

-

Transformer架构:

-

使用Transformer网络作为核心架构,通过堆叠的自注意力和交叉注意力模块,预测高斯头像的属性(如颜色、透明度、尺度和旋转)。

-

Transformer架构的可扩展性使得模型能够处理大规模数据集,进一步提升生成质量。

-

-

FLAME模型驱动的动画:

-

利用FLAME模型的标准线性混合蒙皮(LBS)和修正混合形状进行动画制作,无需额外的神经网络,确保在各种平台上实现高效渲染。

-

通过FLAME模型的动画权重,可以将规范空间中的高斯头像动画化到目标表情和姿势。

-

-

高效部署:

-

使用WebGL框架实现跨平台部署,支持在不同设备(如桌面、移动设备)上进行实时动画和渲染。

-

通过GPU优化和高效的矩阵运算,确保在资源受限的设备上也能实现流畅的动画效果。

-

LAM应用场景

-

在线会议:为视频会议参与者生成个性化的3D头像,提升会议的趣味性和隐私保护。

-

虚拟现实(VR)和增强现实(AR):创建逼真的虚拟角色,增强沉浸感,适用于社交、游戏和培训等场景。

-

游戏开发:快速生成高质量的NPC(非玩家角色)头像,丰富游戏内容,降低开发成本。

-

影视制作:用于创建虚拟角色或替身,便于特效制作,节省时间和成本。

-

社交媒体:用户可以生成个性化的头像,用于个人资料或动态发布,增加互动性和个性化。

-

教育与培训:在虚拟课堂或培训中生成教师和学生的虚拟形象,提升教学的趣味性和参与度。

LAM项目入口

项目地址:https://aigc3d.github.io/projects/LAM/

Github地址:https://github.com/aigc3d/LAM

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号