MOFA-Video项目简介

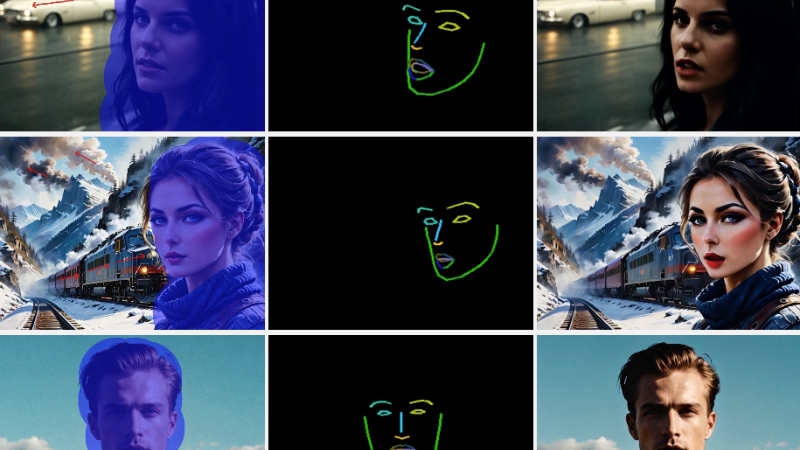

MOFA-Video是一种先进的图像动画控制方法,由东京大学和腾讯AI实验室的研究团队共同开发。这项技术能够通过使用不同的可控信号,如人体标记参考、手动轨迹或提供的视频等,将静态图像转化为动态视频。MOFA-Video的核心在于设计了一种名为MOFA-Adapter的领域感知运动场适配器,它能够控制视频生成流程中的运动。研究者们分别训练了手动轨迹和人体标记的适配器,并展示了这些适配器如何在不需要重新训练的情况下协同工作,以实现更加精细的视频动画控制。通过一系列实验和定量比较,MOFA-Video证明了其在可控性、合成质量和多运动领域联合控制方面相较于现有技术的优越性。尽管存在一些限制,例如难以控制与给定图像差异较大的新内容,以及在大量运动引导下可能出现的视觉伪影,MOFA-Video仍然在图像动画领域展示了巨大的潜力和应用前景。

MOFA-Video主要功能

❶手动轨迹动画:用户可以手动绘制对象的运动轨迹,MOFA-Video根据这些轨迹生成动画视频。

❷面部标记序列动画:通过分析面部标记序列,MOFA-Video能够生成与音频同步的面部表情和头部动作。

❸多模态控制:结合手动轨迹和面部标记,MOFA-Video能够在一个统一的框架下同时控制人物面部和背景对象的动作。

❹零样本学习:MOFA-Adapters允许在不同领域中无需重新训练即可进行动画生成,提供了更高的灵活性和控制力。

❺视频生成:从静态图像出发,MOFA-Video能够生成具有自然运动和良好时间一致性的视频。

❻长视频生成:通过周期性采样策略,MOFA-Video能够扩展生成视频的长度,克服了传统视频扩散模型的帧数限制。

❼插件式组合:MOFA-Adapters的设计允许不同控制信号的组合使用,无需额外训练,即可实现复杂的动画效果。

MOFA-Video应用场景

❶电影和视频制作:在电影或视频后期制作中,可以用来生成复杂的动态背景或动画效果,增加视觉冲击力。

❷虚拟现实(VR)和增强现实(AR):为虚拟现实或增强现实应用提供动态内容,增强用户体验。

❸游戏开发:在游戏设计中,MOFA-Video可以用来快速生成游戏角色的动画或动态环境效果。

❹广告和营销:创造吸引人的广告动画,通过动态图像吸引潜在客户的注意力。

❺教育和培训:制作教育内容时,可以用来展示动态过程或原理,使学习材料更加生动和易于理解。

MOFA-Video技术原理

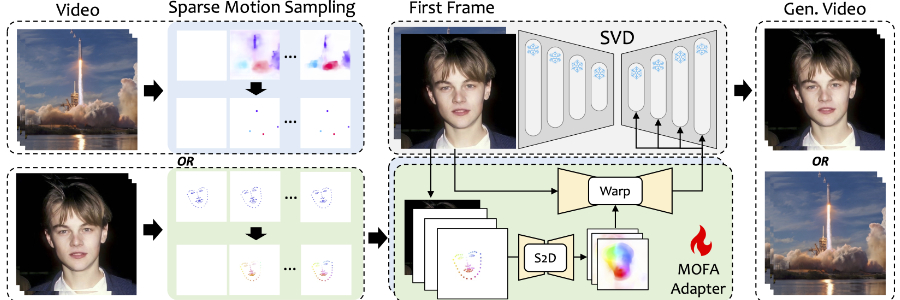

❶MOFA-Adapter:这是MOFA-Video的核心组件,它是一个领域感知的运动场适配器,用于控制视频生成过程中的运动。

❷稀疏到密集的运动生成网络(S2D网络):该网络接受稀疏的运动提示,并生成密集的运动场,从而提供详细的运动控制。

❸引用编码器:它提取第一帧图像的多尺度特征,这些特征随后用于生成过程中的图像变形和运动引导。

❹融合编码器:将经过变换的特征重新融合回预训练的视频扩散模型中,以指导生成过程。

❺视频扩散模型:MOFA-Adapter与冻结的视频扩散模型(如Stable Video Diffusion)结合使用,该模型接受图像作为输入并生成具有空闲动画的视频。

❻训练方法:通过将稀疏运动提示作为输入,训练不同的MOFA-Adapter来生成视频,考虑这些任务作为稀疏控制点生成问题。

MOFA-Video项目入口

- 官方项目主页:https://myniuuu.github.io/MOFA_Video/

- GitHub源码库:https://github.com/MyNiuuu/MOFA-Video

- arXiv研究论文:https://arxiv.org/abs/2405.20222

粤公网安备44011102483711号

粤公网安备44011102483711号