Alter3简介

Alter3是由东京大学一般系统科学系和Alternative Machine Inc.联合开发的先进人形机器人。这款机器人集成了强大的GPT-4大型语言模型,能够理解和执行基于自然语言的指令,展现出零样本学习能力和情感表达能力。Alter3通过其创新的动作映射技术、情感识别算法和动态反馈调整机制,实现了高度的交互性和适应性,使其在教育、娱乐、服务等多个领域具有广泛的应用潜力。

Alter3主要功能

❶自然语言指令响应:根据自然语言描述生成相应的动作序列。

❷情感和表情模拟:通过面部表情和身体语言传达情感状态。

❸零样本学习:无需特定训练即可执行新动作。

❹动作多样性:能够执行从简单到复杂的各种动作。

❺姿势模仿:模仿人类或动物的姿势。

❻交互式反馈:根据用户的口头反馈调整动作。

❼动作记忆与学习:存储和利用改进后的动作记忆。

❽场景适应性:适应不同场景,执行相应动作。

Alter3技术原理

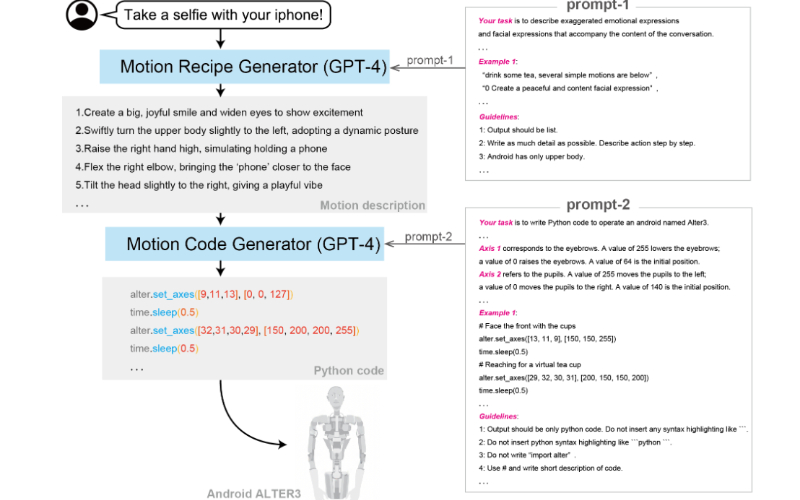

❶大型语言模型集成:将GPT-4等LLM集成到机器人中,使其能够理解自然语言指令。

❷动作映射技术:将语言描述转换为机器人的物理动作。

❸自然语言处理(NLP):解析自然语言指令,提取动作信息。

❹思维链架构:使用思维链方法将指令转换为动作序列。

❺外部记忆系统:存储和检索动作记忆,用于改进动作执行。

❻数据库与标签系统:使用数据库和标签组织动作记忆,便于搜索和应用。

❼情感识别算法:识别文本中的情感并映射到机器人表情和动作。

❽迭代学习机制:根据反馈不断优化动作表现。

❾非确定性动作生成:利用LLM的非确定性生成多样化动作。

❿用户交互设计:设计易于使用的界面,实现与机器人的自然语言交互。

Alter3性能评估

❶动作生成能力评估:研究者们通过让GPT-4生成九种不同的动作视频,并将其分为即时手势和一段时间内的动作两种类型,来评估GPT-4生成动作的能力。这些动作包括日常动作如自拍和喝茶,以及模仿动作如假装鬼魂和蛇。

❷参与者评估:招募了107名参与者通过Prolific平台,他们观看了这些视频并根据5点评分量表对GPT-4的表达能力进行评估。

❸控制组对比:研究中还包括了一个控制组,使用Alter3的随机动作,并附上由GPT-4生成的随机动作注释。这些控制视频被巧妙地混入调查中,用于比较。

❹统计分析:使用了Friedman测试和Nemenyi后续测试来分析评分之间的显著性差异。结果显示,与控制组相比,GPT-4生成的动作得到了显著更高的评分。

❺结果的统计显著性:研究者们认为,如果p值小于或等于0.001,则差异具有统计学意义。GPT-4生成的动作与控制组相比,评分显著更高,表明GPT-4生成的安卓动作与控制组的动作在感知上存在显著差异。

❻情感表达的准确性:GPT-4不仅能够生成动作,还能够根据文本内容推断和表达适当的情感,如尴尬或快乐,即使文本中没有明确的情感表达。

❼动作记忆与改进:Alter3能够存储和利用改进后的动作记忆,通过积累关于其身体的信息,作为身体模式的一部分,从而提高动作的自然度和适应性。

❽用户反馈的整合:用户可以通过语言反馈指导Alter3的动作调整,这些反馈被用来改进动作并存储为动作记忆,从而在未来的动作生成中使用。

Alter3项目入口

官方项目主页:https://tnoinkwms.github.io/ALTER-LLM/

粤公网安备44011102483711号

粤公网安备44011102483711号