MimicMotion项目简介

MimicMotion 是由腾讯公司与上海交通大学联合开发的一项先进的视频生成技术。这项技术能够根据指定的动作指导生成高质量、任意长度的人类动作视频。它通过引入独特的置信度感知姿势引导和区域损失放大机制,显著提升了帧质量、时间平滑性,并减少了图像失真。此外,MimicMotion 采用了一种创新的渐进式潜在融合策略,有效解决了长视频生成中的挑战,确保了视频在任意长度下都能维持可接受的资源消耗和优异的视觉效果。

MimicMotion主要功能

❶高质量视频生成:能够生成高分辨率且细节丰富的人类动作视频。

❷任意长度视频:支持生成不同长度的视频,不受传统视频生成技术的限制。

❸姿势引导控制:可以根据提供的参考图片和姿势序列生成视频,保持与姿势引导的一致性。

❹时间平滑性:确保视频帧之间的过渡自然流畅,避免出现不连贯或突变的现象。

❺资源效率:在生成长视频时,通过优化算法控制资源消耗,保持高效性。

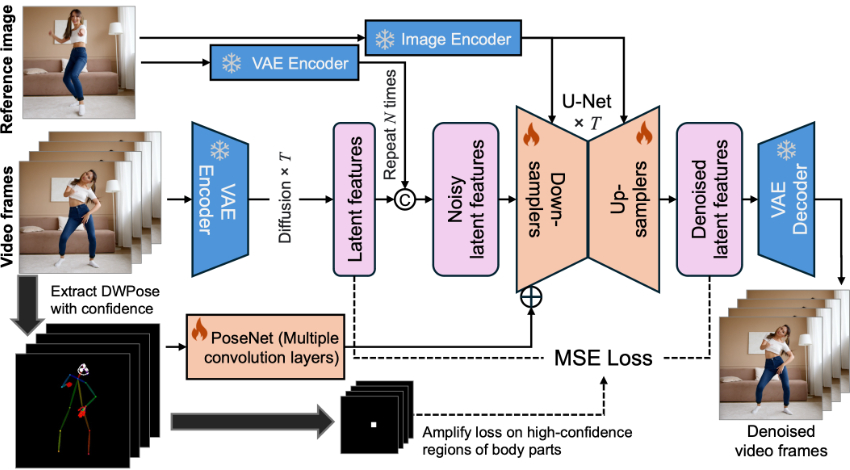

MimicMotion技术原理

❶置信度感知姿势引导:引入姿势置信度的概念,根据姿势估计的准确性调整姿势引导的权重,减少不准确姿势估计的负面影响。

❷区域损失放大:基于姿势置信度,对高置信度区域(如手部)的损失函数进行加权,提高这些区域的生成精度。

❸渐进式潜在融合:为了生成长视频,采用一种在去噪过程中融合重叠帧潜在特征的策略,增强视频段之间的时间连贯性。

❹预训练模型利用:基于一个通用的预训练视频生成模型,减少了从头开始训练视频扩散模型所需的数据量和计算成本。

❺潜在扩散模型(Latent Diffusion Model, LDM):将像素编码到低维潜在空间中进行扩散过程,提高了生成效率和质量。

❻U-Net 和 PoseNet 结构:使用 U-Net 进行潜在空间中的逐步去噪,PoseNet 用于提取输入姿势序列的特征,并将这些特征整合到去噪过程中。

MimicMotion适用人群

❶影视制作人:需要快速生成特效动作视频的导演和视频编辑。

❷ 游戏开发者:设计游戏中角色动画的程序员和动画师。

❸VR/AR设计师:创造沉浸式体验的虚拟现实和增强现实内容创作者。

❹动画艺术家:利用技术辅助传统动画创作的专业人士。

❺体育教练:分析和模拟运动员动作的教练和分析师。

❻医疗专业人员:在康复领域使用动作模拟的医生和治疗师。

❼时尚设计师:展示服装动态效果的服装设计师。

❽教育工作者:利用视频模拟教学的教育者和培训师。

❾广告创意人员:设计吸引人的广告内容的广告创意和市场营销人员。

❿社交媒体用户:希望创作和分享个性化视频内容的普通用户。

MimicMotion项目入口

- 官方项目主页:https://tencent.github.io/MimicMotion/

- GitHub源码库:https://github.com/tencent/MimicMotion

- arXiv研究论文:https://arxiv.org/abs/2406.19680

粤公网安备44011102483711号

粤公网安备44011102483711号