SpeechGPT:复旦大学等推出的跨模态对话模型

SpeechGPT简介

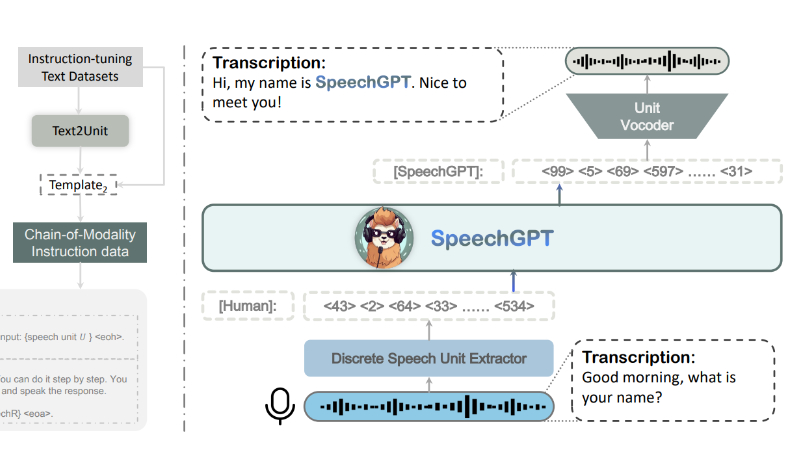

SpeechGPT 是由复旦大学计算机科学学院和智能信息处理上海重点实验室的研究团队开发的一项创新技术。这项技术突破了传统大型语言模型的局限,赋予了模型以自然的方式理解和生成跨模态内容的能力。通过构建大规模的跨模态语音指令数据集 SpeechInstruct,SpeechGPT 能够处理复杂的语音指令,并以语音或文本的形式提供响应。它采用了独特的三阶段训练策略,包括模态适应预训练、跨模态指令微调和链式模态指令微调,显著提升了模型在多模态任务中的表现。这项研究不仅展示了在人工智能领域中多模态交互的潜力,也为未来实现更加自然和智能的人机对话提供了新的可能性。

SpeechGPT主要功能

- 多模态内容感知与生成:SpeechGPT 能够理解语音和文本信息,并生成相应的语音或文本回应。

- 跨模态对话:模型能够处理语音和文本之间的对话,实现跨模态的自然交流。

- 遵循多模态指令:用户可以给出语音或文本指令,SpeechGPT 能够理解和执行这些指令。

- 口语对话能力:模型能够与人类进行自然的口语对话,理解语音输入并用语音回应。

- 自监督学习:通过自监督学习,SpeechGPT 能够从大量未标记的语音数据中学习语音表示。

SpeechGPT技术原理

- 离散语音表示:使用自监督训练的语音模型(如 HuBERT)将连续的语音信号转换为离散单元,实现语音的数字化表示。

- 模态统一:将离散的语音单元与文本的词汇表统一,使得模型能够处理两种模态的输入和输出。

- 大规模数据集构建:创建了 SpeechInstruct,一个大规模的跨模态语音指令数据集,用于训练和评估模型。

- 三阶段训练策略:

- 模态适应预训练:使用未标记的语音数据训练模型,使其适应离散的语音单元。

- 跨模态指令微调:利用 SpeechInstruct 数据集,进一步训练模型以提高跨模态指令的执行能力。

- 链式模态指令微调:通过链式模态指令数据,优化模型以更好地处理连续的模态转换任务。

- 参数高效微调:采用 LoRA(Low-Rank Adaptation)技术对模型进行微调,以提高训练效率并减少参数数量。

- 多模态输入输出架构:模型设计了统一的框架来处理不同模态的输入和输出,包括离散单元提取器、大型语言模型和单元声码器。

- 自回归语言模型:基于自回归的语言模型,用于生成文本和语音回应,确保上下文的连贯性和语义的准确性。

SpeechGPT应用场景

- 智能助手:作为智能手机或智能家居设备的语音助手,提供信息查询和任务执行。

- 客户服务:在客户服务中心,自动处理客户的咨询和投诉,提供语音回复。

- 语言学习:辅助语言学习者练习发音和听力,提供即时的语音反馈。

- 辅助技术:为视障或读写困难人士提供文本到语音的转换服务。

- 内容创作:帮助内容创作者将文本内容转换为有声读物或播客。

- 多语言翻译:实现不同语言之间的实时语音翻译,促进跨语言交流。

SpeechGPT项目入口

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号