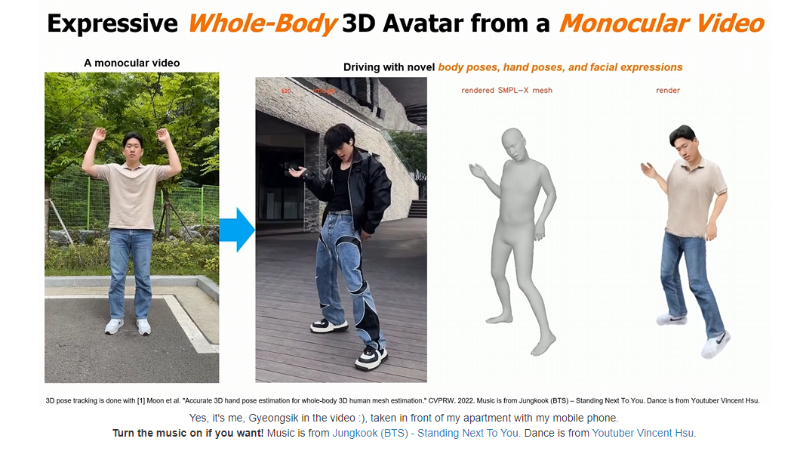

ExAvatar简介

ExAvatar是由DGIST和Meta公司的Codec Avatars Lab开发团队创造的3D数字形象生成模型。它通过结合全身参数化网格模型(SMPL-X)和3D高斯Splatting(3DGS),从一个简短的单目视频中学习生成一个可以展现丰富面部表情和手部动作的全身3D人体化身。ExAvatar的创新之处在于其混合表示方法,使用3D高斯作为顶点处理,这些顶点遵循SMPL-X网格拓扑的预定义连接信息,从而使得即使在视频中表情和姿势的多样性有限,也能够以新的面部表情和姿势进行动画制作,同时显著减少在新表情和姿势下的伪影。

ExAvatar主要功能

- 全身3D建模:ExAvatar能够从单个视频中创建出全身3D模型,包括面部、身体和手部。

- 面部表情动画:支持多种面部表情的动画,包括微笑、皱眉等复杂表情。

- 手势动画:能够模拟手部动作,与面部表情一样,可以进行动态变化。

- 身体动作模拟:可以模拟人体的各种身体动作和姿态。

- 高真实感渲染:利用3DGS技术,ExAvatar能够实现逼真的渲染效果。

ExAvatar技术原理

- 参数化网格模型(SMPL-X):ExAvatar基于SMPL-X模型,这是一个参数化的全身人体网格模型,能够通过参数控制人体的形状和姿势。

- 3D高斯溅射(3DGS):结合3DGS技术,ExAvatar能够在渲染时提供更加细腻和真实的视觉效果。

- 混合表面网格与3D高斯表示:ExAvatar将3D高斯点视为网格表面顶点,这些顶点遵循SMPL-X的网格拓扑结构,具有预定义的连接信息。

- 面部表情和姿势的多样性:通过设计混合表示方法,ExAvatar能够处理视频中面部表情和姿势的有限多样性问题。

- 3D观测数据的缺失:针对缺乏3D扫描或RGBD图像的问题,ExAvatar通过其算法设计减少了在未观测到的人部位(如被遮挡的部分)产生显著伪影的可能性。

- 基于连接的正则化:使用基于网格连接的正则化技术,ExAvatar在新的面部表情和姿势下显著减少了伪影。

- 动画和渲染流程:ExAvatar通过特定的动画和渲染流程,将3D模型与SMPL-X的驱动信号结合,实现动态的面部和身体动画。

ExAvatar应用场景

- 虚拟角色创建:在电影、游戏和动画制作中,快速生成具有真实表情和动作的3D角色。

- 虚拟现实交互:为用户提供更加自然和真实的虚拟角色交互体验。

- 增强现实演示:在AR应用中,将3D化身与现实世界融合,用于教育或商业演示。

- 社交媒体和娱乐:允许用户在社交平台上以3D形象出现,进行直播或分享动态。

- 个性化培训和模拟:在专业培训领域,模拟真实人物动作和反应,用于军事或医疗培训。

- 远程协作和会议:在远程工作场景中,使用3D化身进行更加直观和互动的在线会议。

ExAvatar项目入口

-

GitHub代码库:https://mks0601.github.io/ExAvatar/

-

arXiv技术论文:https://arxiv.org/abs/2407.21686

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号