GenWarp:能够从单个图像生成具有语义保持的新视角图像

GenWarp简介

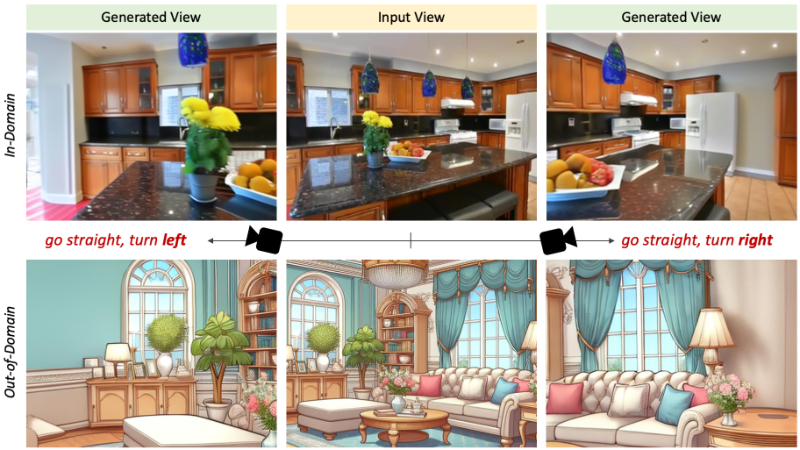

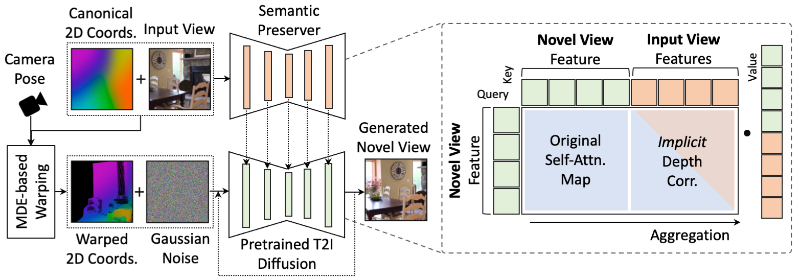

GenWarp 是由 Sony AI 团队开发的一种创新的图像生成框架,它能够从单个图像生成具有语义保持的新视角图像。该框架通过结合自注意力和交叉视角注意力,使得文本到图像(T2I)生成模型学会在何处进行图像变形和在何处进行内容生成,从而在不依赖于不可靠的变形图像的情况下,有效地保持源图像的语义细节。这种方法在处理各种场景和视角变化时,展现出了优越的性能,特别是在面对具有挑战性的相机视角变化时,能够生成更高质量的新视角图像。

GenWarp主要功能

- 单图像新视角生成:能够从单个输入图像生成新的视角图像。

- 语义保持:在生成新视角的过程中,保持输入图像中的语义信息。

- 处理领域内外图像:不仅能够处理训练数据集中的图像,也能处理来自不同领域的未知图像。

- 几何变形与生成一体化:将图像变形和内容生成集成到一个统一的过程中,而非分步处理。

GenWarp技术原理

- 深度估计与几何变形:使用单目深度估计(MDE)模型预测输入图像的深度图,然后基于预测的深度图和目标视角进行图像的几何变形。

- 文本到图像(T2I)模型:利用大规模预训练的 T2I 模型,通过文本提示生成高质量的图像内容。

- 自注意力与交叉视角注意力:通过增强自注意力机制,引入交叉视角注意力,使模型能够学习在图像的哪些部分进行变形,在哪些部分进行内容生成。

- 端到端训练:整个框架支持端到端训练,通过优化一个统一的损失函数来微调预训练的 T2I 模型。

- 多视角数据集:在多个室内和室外场景的多视角数据集上进行训练,以提高模型的泛化能力。

- 噪声深度图处理:通过设计模型来减少对噪声深度图的依赖,从而减少变形过程中的误差。

- 语义特征融合:在生成过程中融合输入视图的语义特征,以保持生成图像的语义一致性。

GenWarp应用场景

- 虚拟现实(VR)和增强现实(AR):在 VR 和 AR 应用中,GenWarp 可以用于从单一图像生成逼真的 3D 环境,提升用户的沉浸式体验。

- 室内设计可视化:设计师可以利用 GenWarp 从单一的 2D 图纸或照片生成 3D 室内装修效果,帮助客户更直观地预览设计成果。

- 游戏和娱乐:在游戏开发中,GenWarp 能够辅助创建多样化的游戏场景,通过单一图像生成丰富的视角变化,增加游戏的可玩性。

- 电影和动画制作:电影制作人员可以使用 GenWarp 从现有的静态图像或场景草图中生成新的视角镜头,加快特效制作流程。

- 机器人视觉系统:在机器人导航和环境识别中,GenWarp 可以帮助机器人从单一视角图像预测其他视角的场景布局,提高决策效率。

- 电子商务:在线购物平台可以利用 GenWarp 技术,允许用户从不同角度查看产品,即使产品只有一张图片,也能提供更全面的视角展示。

GenWarp项目入口

- 官方项目主页:https://genwarp-nvs.github.io/

- GitHub代码库:https://github.com/sony/genwarp

- arXiv研究论文:https://arxiv.org/abs/2405.17251

- 在线体验:https://huggingface.co/spaces/Sony/genwarp

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

粤公网安备44011102483711号

粤公网安备44011102483711号